自編碼器學隨機動態也要顧幾何

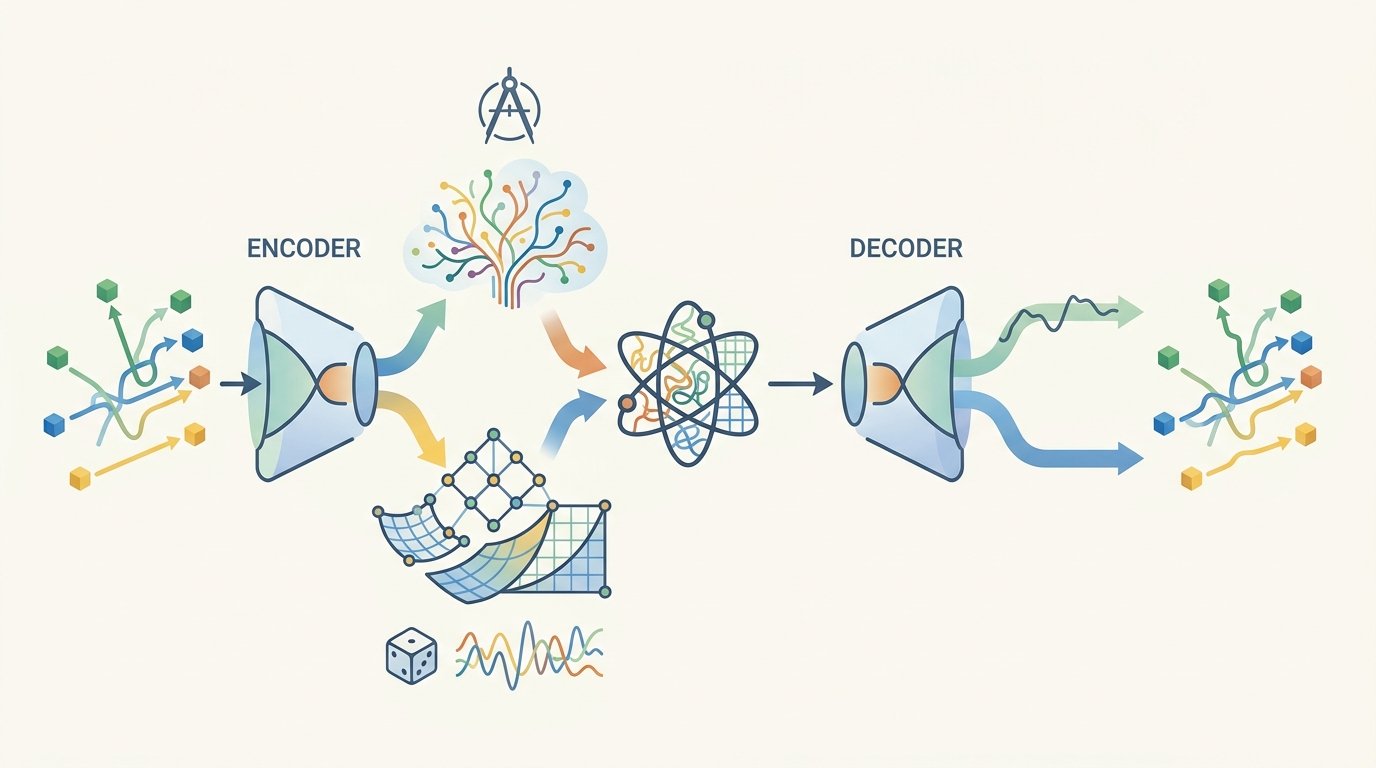

這篇論文把切空間與逆一致性正則化加進自編碼器,用來從高維隨機資料學更可靠的降維模擬器。

高維隨機系統看起來很複雜,但很多時候,真正有意義的長期動態只活在一個更小的低維流形上。問題是,怎麼從高維空間裡抓到這個結構,還要讓後續學到的降維模擬器真的能用?這篇論文 Geometric regularization of autoencoders via observed stochastic dynamics 的答案很直接:不要只學一個壓縮表徵,還要把幾何約束一起放進去。

作者關心的不是單純重建得像不像,而是重建之後能不能把漂移與擴散也學對。這件事對做科學機器學習、降階模擬、或 latent dynamics 的人來說很關鍵。因為在這類問題裡,表示學歪了,後面的動態辨識就會一起歪。看起來 chart 很漂亮,不代表學出來的 SDE 真的準。

這篇論文在解什麼痛點

這篇工作鎖定的是一個老問題:手上只有高維空間裡的短暫觀測片段,能不能建出一個低維模擬器,去描述系統在長時間尺度上的慢動態或亞穩態動態。這類系統常見於隨機過程,資料雖然散在高維環境裡,但真正有用的行為其實集中在某個未知流形附近。

傳統的局部座標方法,例如 ATLAS,可以做這件事,但論文點出兩個現實痛點。第一,landmark 的規模會指數成長。第二,每一步都要重新投影。這些流程在理論上可行,但工程上很重。相對地,自編碼器式的方法少掉一些機械式步驟,卻常常沒有把切叢幾何約束好,導致學到的 chart 只是在表面上可用。

作者想修的,就是這個「表示學習和動態學習彼此拖累」的問題。若幾何不穩,後面估出來的 drift 和 diffusion 就容易跟著失真。換句話說,這不是單純的重建誤差問題,而是整個 reduced simulator 的可信度問題。

方法到底怎麼做

論文的核心觀察是:觀測到的隨機軌跡,其局部 covariance 本身就帶有幾何訊號。文中把這個 covariance 記成 Λ,並指出它是座標不變的資訊,能反映切空間方向。直白一點說,資料在局部怎麼抖動,已經在幫你指出流形的切方向在哪裡。

基於這個觀察,作者加入兩個正則項。第一個是 tangent-bundle penalty,用來逼近學到的 chart 和 covariance 所暗示的切幾何對齊。第二個是 inverse-consistency penalty,讓 encoder 和 decoder 不只是勉強互補,而是真的盡量像彼此的反函數。這樣一來,編碼與解碼不會各走各的,幾何結構也比較不容易在中間被扭壞。

這些約束被塞進一個三階段流程:

- 先學 chart,

- 再學 latent drift,

- 最後學 latent diffusion。

也就是說,先把表示空間搭起來,再在這個 latent 空間裡估計隨機動態。論文不是把幾何當附加說明,而是直接把它當成 regularizer,去塑形整個 reduced model。

另外,作者還提出一個 function-space metric,叫做 ρ-metric。摘要裡的重點是:它比 Sobolev H1 norm 還弱,但在 chart 品質的泛化率上,仍然能達到同樣等級,只差對數因子。對實作端來說,這代表它想要的是一種沒那麼重手、但仍足以約束 chart 的幾何規範。

理論上證明了什麼

在理論部分,作者用 Itô’s formula 套在學到的 encoder 上,推導出一個 encoder-pullback 的 drift 目標。這個做法的重點是,漂移不是直接從 decoder 端硬算,而是透過 encoder 的幾何結構回推。這比只看 decoder 更貼近學到的座標系統。

論文也做了 bias decomposition,指出如果 chart 不是完美的,那麼常見的 decoder-side drift 公式會出現系統性誤差。這一點很重要,因為它把一個常被忽略的事講白了:不是你有 decoder 就夠了,chart 一旦有偏,後面算出來的動態量就可能有可預期的偏差。

另外,作者聲稱在 W2,∞ 的 chart-convergence 假設下,chart-level 的誤差可以可控地傳遞到 ambient dynamics 的 weak convergence,還能傳到 radial mean first-passage times 的收斂。這表示他們不是只看重建,而是把幾何誤差和實際會用到的隨機量連起來。

這種理論連結對研究者和工程師都很實用。因為很多時候,大家只知道 latent 表示「看起來不錯」,卻不知道它對長時間模擬到底有沒有幫助。這篇論文試著把這條鏈條補上:幾何誤差 → 動態偏差 → 長時統計量誤差。

實驗結果說了什麼

摘要裡公開的實驗資訊不算完整,但仍然給了幾個明確訊號。作者把方法測在四個嵌入到最多 201 維 ambient space 的曲面上。這代表測試場景不是低維玩具,而是有一定高維壓力的幾何設定。

在 rotation dynamics 下,論文報告 radial MFPT error 下降了 50% 到 70%。在 metastable 的 Müller–Brown Langevin dynamics 上,方法在多數 surface-transition pairs 中拿到最低的 inter-well MFPT error。除此之外,end-to-end 的 ambient coefficient errors,相較於未加正則化的 autoencoder,最多下降到一個數量級。

這些結果的共同點是:幾何正則化不是只讓重建更順眼,而是實際改善了後續動態估計。尤其是 MFPT 這種跟長時間行為有關的量,通常比單步重建更能反映模型有沒有真的學到系統結構。

不過也要注意,摘要沒有公開完整 benchmark 細節,所以如果你想知道每個 case 的完整表格、訓練設定、或更細的比較對象,仍然要去看全文。就目前摘要能看到的內容來說,作者主要是用誤差下降幅度來證明幾何約束有用。

對開發者有什麼影響

如果你在做 scientific ML、降階模擬、或 latent SDE,這篇論文提供了一個很實際的設計方向:不要把 representation learning 和 dynamics learning 分開看。latent space 不是純壓縮工具,它本身就是模型的一部分。chart 一旦幾何不對,後面的 drift 和 diffusion 再怎麼調也可能是在補洞。

這篇方法的思路,也很適合用來提醒實作流程要怎麼排。先用觀測到的 covariance 去約束 tangent geometry,再用 encoder 端的表示去學動態,會比只靠 reconstruction loss 更有機會得到可用的 reduced simulator。對有短 burst 資料、高維觀測、又想做長時間預測的人來說,這是很有吸引力的 pipeline。

它也給了一個更廣的工程啟示:當你處理的是慢流形、亞穩態、或幾何結構明顯的系統時,單看輸出像不像通常不夠。你可能還需要看模型有沒有把切空間、逆一致性、以及 latent dynamics 的一致性一起顧到。

限制與還沒回答的問題

這篇論文的方向清楚,但限制也同樣清楚。首先,理論保證建立在 W2,∞ chart-convergence 假設上。這是一個不算輕的條件。意思是,漂亮的收斂故事成立的前提,是 chart 的品質要先以某種方式穩定下來;但在真實資料裡,這件事未必容易驗證。

第二,摘要提供的實驗仍然是控制良好的設定。四個曲面、最多 201 維嵌入、再加上幾類指定動態,這足以展示方法有效,但還不能直接推論到所有噪聲感測資料或所有工業場景。摘要也沒有宣稱有更廣泛的部署結果。

第三,這個方法還是要先學到一個夠好的 nonlinear chart。幾何正則化能改善這件事,但不能把有限資料、非平穩動態、或觀測太少的問題直接消掉。也就是說,它是補強,不是魔法。

整體來看,這篇論文的價值在於把一件常被分開處理的事重新接起來:表示學習和隨機動態估計,其實是同一個問題的兩面。若你想做的是能長時間運作的 reduced simulator,幾何可能不是可有可無的附加項,而是模型能不能站得住的核心條件。