為什麼 OpenAI 不能再把暴力威脅當成門檻測試

OpenAI 在系統已標記出涉槍手帳號後仍未通報警方,是錯誤的;公司應把「可信暴力訊號」的升級標準調低、調快,而不是等到“迫在眉睫”才行動。

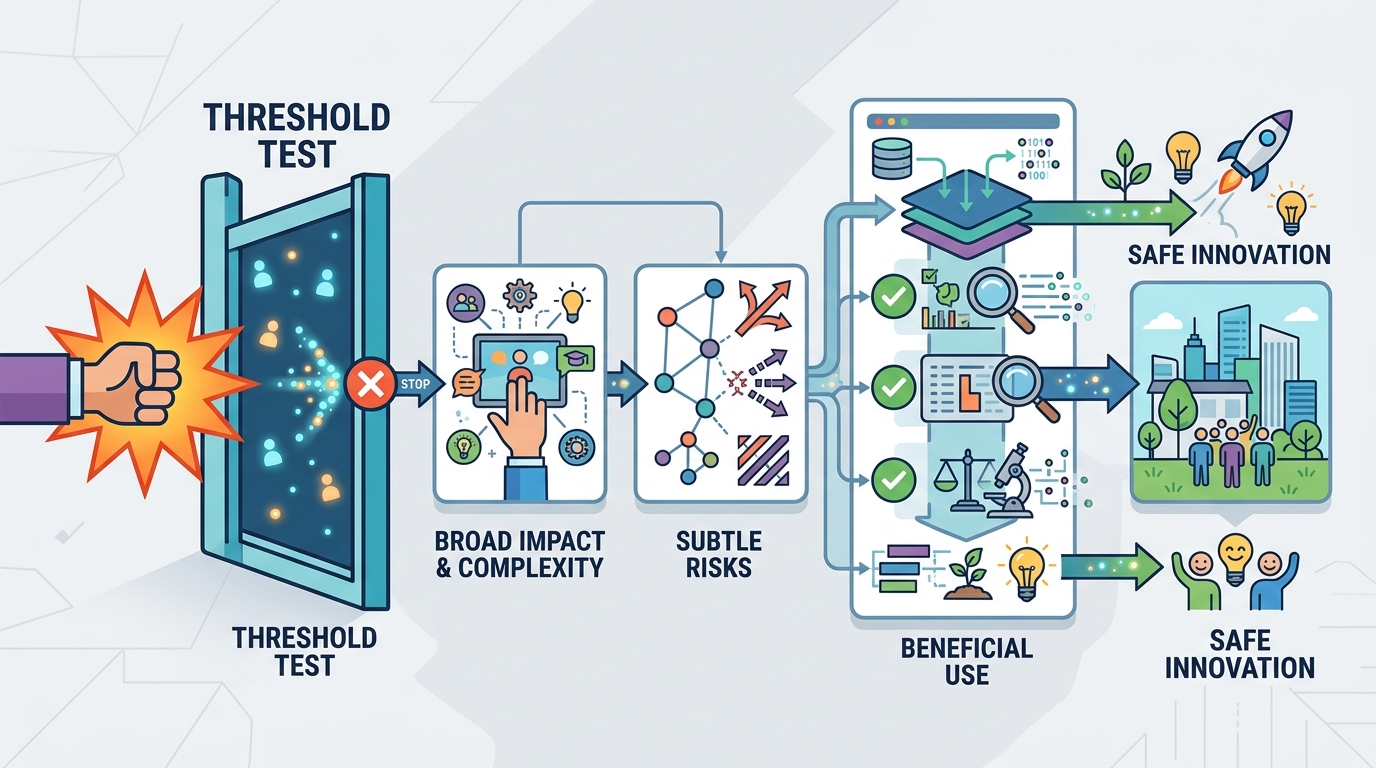

OpenAI 不該再等到「imminent and credible」這種高門檻才把暴力威脅通報執法單位。

這次 Tumbler Ridge 案件把問題講得很清楚。CBS News 報導,OpenAI 在 2025 年已標記那名槍手的 ChatGPT 帳號、封禁該帳號,但仍判定未達通報標準,因此沒有通知警方。事後,Altman 對社群表示,對於帳號沒有被報告「深感抱歉」。道歉重要,但政策失靈更重要。公司既然已經拿到足以觸發自動偵測與人工審查的訊號,就不該再把責任關在內部。當 AI 系統能大規模辨識計畫、執念與演練時,狹義的法律門檻不是安全政策,而是延誤機制。

第一個論點

OpenAI 目前的做法,把「確定性」看得太重,把「預防」看得太輕。當模型已經標記出暴力內容,且人工審查員也判定足以封禁帳號,平台面對的就不再是一般濫用,而是已跨入需要外部介入的危險行為。若還要等到證明傷害「迫在眉睫」,等於假設公司能可靠分辨幻想與準備行動,但這種分辨並不穩。安全系統的目的,是在證據變成屍體之前介入。

OpenAI 自己公開的處理流程已經透露張力。公司在 2 月表示,該帳號先被自動工具與人工調查標記,之後因違規被封禁。這不是小事,而是內部已做出「危險到必須移除」的具體判斷。既然平台有足夠信心切斷服務,就有足夠理由把同樣的風險訊號交給受過訓練的人來看。真正的失誤不是沒有訊號,而是拒絕把訊號帶出公司邊界。

第二個論點

這套流程還製造了不該存在的責任缺口。當平台握有日誌、提示詞、風險分數與審核備註,它其實是唯一能看見完整威脅軌跡的機構。這讓公司不只是平台,而是關卡守門人。如果它把警示留在內部,事後再說門檻未達,公眾只能被迫信任一個無法即時驗證的私人判斷。涉及潛在大規模暴力時,這種安排站不住腳。

佛州案件讓對比更明顯。CBS News 報導,OpenAI 在得知該事件後,辨識出一個被認為與嫌疑人相關的 ChatGPT 帳號,並主動把資訊交給執法單位。這表示公司不是做不到快,而是選擇性地快。問題因此不是技術能力不足,而是政策不一致。當一家全球規模的公司對類似風險訊號採取不同處理方式,外界批評的就不只是失誤,而是標準失衡。對安全產品而言,失衡本身就是風險。

反方可能怎麼說

最強的反對意見是:過度通報會造成真實傷害。如果每個令人不安的提示都被送進警局,使用者隱私會受損,審核人員會被假陽性淹沒,執法資源也會被噪音拖垮。過度激進的升級機制,還可能壓縮正當言論,尤其是小說、新聞、心理健康或政治憤怒的討論。再加上未經高門檻就交出使用者資料,本身就有嚴重法律與倫理問題。從這個角度看,OpenAI 的「imminent and credible risk」標準,是為了避免安全監控滑向大規模監視。

這個顧慮是真的,不能被輕描淡寫帶過。但它不足以替這次失誤辯護。封禁加人工審查,已經不是原始關鍵字命中,而是經過過濾的高訊號事件。答案不是把所有東西都報出去,而是建立更窄、更快的升級條件:當帳號反覆出現暴力執念、規劃語言,或明顯的操作性思維時,必須由受訓的安全團隊快速複核,並保留通報執法單位的明確路徑。OpenAI 不需要撒網,它需要更銳利的扳機。佛州案例已證明,當公司認定風險夠高時,它做得到。

你能做什麼

如果你是工程師、產品經理或創辦人,正在打造可能接觸到傷害訊號的 AI 系統,別再把危機處理當成法律部門的事後補丁。你應該從產品設計一開始就把升級機制寫進去,明確定義暴力意圖的判準、建立快速人工複核流程,並把「出現反覆且可信的現實世界危險指標時,預設通報」當成原則。如果你是 PM 或創辦人,不要躲在那些高到失效的門檻後面。安全政策應該為最糟的一天設計,不是為平均情況設計。