AI 工作為何需要提示標準

Springer 新章節主張提示工程需要共通標準,才能減少 Token 浪費、降低錯誤,並讓 AI 工作更好追蹤與審核。

一個 prompt,就能多燒幾十個 Token。也可能把答案帶歪。這不是小事,尤其是 AI 已經進到正式產品流程。Springer Nature 新章節直接把 prompt engineering 當成一門工程,不是聊天技巧。

講白了,團隊開始把 AI 放進客服、搜尋、內部知識庫後。prompt 寫法就會反映在成本、品質、法遵,還有使用者信任上。你寫得鬆,模型就亂補。你寫得清楚,系統才有機會穩。

這篇章節的核心很直白。prompt 不是一段文字而已。它更像介面規格。只要 prompt 會影響模型行為,那它就需要規則、詞彙、格式,還有可重複的結構。

Prompt 為什麼不只是文字

作者 Hamid Tavakoli 把 prompt 看成結構化設計工具。我覺得這個說法很準。LLM 不會像人類那樣自己補齊意圖。它會吃你的措辭、順序、限制、範例,還有上下文長度。

所以,prompt 不是「跟 AI 說一句話」而已。它比較像 OpenAI 文件裡那種提示格式設計。你少寫一個角色,少寫一個輸出格式,模型就自己猜。猜對算運氣,猜錯才是常態。

這也會直接變成錢。模糊指令通常會讓模型輸出更長,重試更多,Token 消耗也更高。若一個產品每月有 100 萬次互動,浪費就不是零頭,而是雲端帳單上的真金白銀。

更麻煩的是品質。prompt 沒寫清楚時,模型會自己補洞。它有時候會補對,但更多時候會變成空泛、冗長,或根本答非所問。這種錯誤最討厭,因為表面看起來還很像真的。

- prompt 結構會影響長度、準確度、穩定性。

- Token 浪費會在高流量產品裡快速累積。

- 高風險場景需要明確限制,不適合靠感覺寫。

- 共通格式能讓審核、測試、交接更簡單。

所以標準不是拿來管死大家。它是拿來減少猜測。當團隊對同一件事有同一種描述方式,prompt 才能被比較、被測試,也才有機會被改好。

這個方向也和 Anthropic、Google Gemini 的建議一致。說穿了就是一句:清楚通常比花俏有用。

倫理問題其實藏在 prompt 裡

prompt 不只是為了拿到更好的答案。它也牽涉責任。Tavakoli 提醒,寫得不好的 prompt,會在醫療、法律、教育、公共服務裡造成誤解。這些地方一旦出錯,後果不是「再試一次」就能解決。

問題是,prompt 錯誤常常很安靜。模型可以講得很像真的,但其實完全沒抓到需求。這時候很多人會怪模型幻覺,卻忘了原始指令本來就寫得含糊。

所以,prompt literacy 其實就是 AI 時代的基本素養。你要知道指令怎麼影響模型,也要知道出事時責任怎麼分。這點很現實,沒有什麼浪漫可言。

“The future of AI is not about replacing humans, it’s about augmenting human capabilities.” — Satya Nadella

這句話來自 Microsoft 執行長 Satya Nadella。拿來對照這章節,剛剛好。所謂協作,不是人丟一句話給機器就結束。人要先把需求說清楚,機器才有機會接得住。

這也代表 prompt 不該只是個人習慣。它應該進到模板、版本控管、審核流程。只要 prompt 會影響安全性,它就該像其他 production artifact 一樣被記錄。

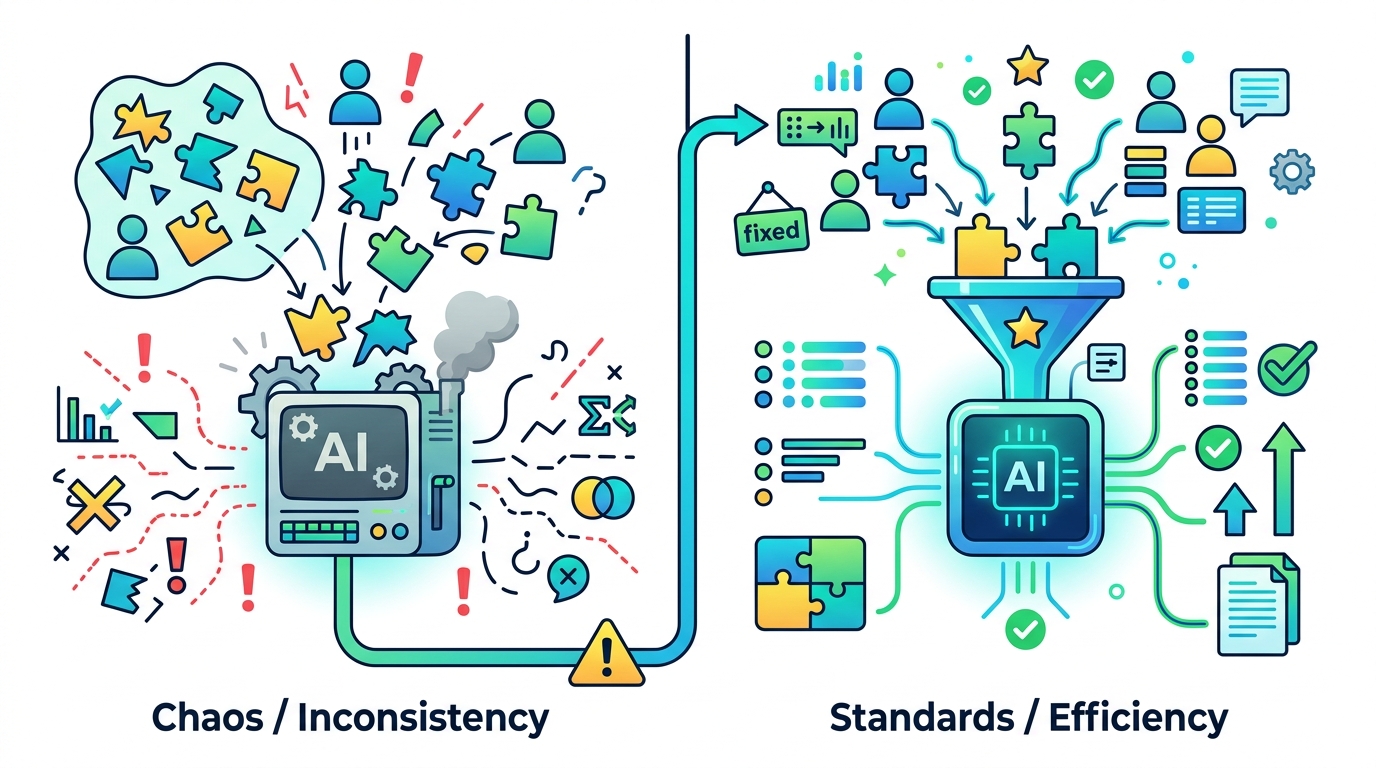

標準到底能修什麼

章節裡提到 Prompt Anatomy Blueprint。名字很新,但邏輯很老實。先定義任務,再定義上下文,再定義輸出格式,最後定義限制。這其實跟寫規格文件很像。

這種結構有一個很實際的好處。它會讓 AI 工具沒那麼飄。你不用每次都靠試錯碰運氣。對團隊來說,這差很多,因為大家可以開始比品質,而不是比誰比較會講話。

更重要的是,標準能讓 prompt 變成可測試的東西。只要格式固定,團隊就能跑 A/B test、看 Token 數、看指令遵從率。這些數字一出來,討論就不會只剩「我覺得這版比較順」。

- OpenAI 的提示指南強調具體與格式清楚。

- Anthropic 文件強調角色與任務要明確。

- Google Gemini 文件也在講指令清晰與範例。

- Prompt Engineering Guide整理了很多可重用模式。

這些來源方向其實很一致。只是各家叫法不同。Tavakoli 的貢獻,在於把這件事往前推一步。他不是只說「要寫好 prompt」,而是說「要把 prompt 標準化」。

你可以把它想成 unit test 進入軟體開發的那種變化。程式以前也能寫,但有了測試後,品質才變成可管理的事。prompt 標準化也可能走同樣路。

跟其他 AI 寫法比,差在哪

現在很多團隊還在用很隨性的寫法。今天一個人寫,明天另一個人改,格式全靠感覺。這種做法在 demo 階段還能混過去,但一進 production 就開始出事。

如果拿三大平台來看,差異很明顯。OpenAI 偏向清楚指令與格式。Anthropic 很重視角色、任務和上下文。Google 則一直提醒你要給範例。三家都在講同一件事,只是包裝不同。

如果你要比效果,差距通常會落在這幾個地方。不是玄學,是工程細節。尤其在大規模部署時,模板化 prompt 會比臨場發揮穩很多。

- 無標準 prompt:多人共用時容易失真。

- 模板化 prompt:較容易重用與維護。

- 有測試的 prompt:比較能追蹤錯誤來源。

- 有版本控管的 prompt:方便回溯與審核。

競品面也很現實。當企業同時用 OpenAI、Anthropic、Google DeepMind 的模型時,如果沒有共通 prompt 格式,評估結果會亂掉。你很難知道是模型差,還是 prompt 寫法差。

這也是為什麼標準很重要。它不是學術潔癖,而是比較成本。當你能把 prompt 統一,模型比較才有意義,團隊也才有辦法做真正的決策。

這件事其實已經不是新話題

我覺得 prompt 標準化會被討論,不是因為大家突然變聰明。是因為 AI 已經進到真實工作流。以前玩 chatbot,錯了就算了。現在進客服、法務、內部搜尋,錯一次就會留下紀錄。

所以產業脈絡很清楚。早期重點是能不能回答。現在重點是能不能重複、能不能稽核、能不能控成本。這三件事一變成 KPI,prompt 就不可能再被當成隨手輸入。

這也解釋了為什麼很多公司開始做 prompt library、prompt review、prompt QA。老實說,這些東西以前聽起來有點煩。現在卻很像基本配備。你不做,後面就等著補洞。

而且這股趨勢不只在新創。大型企業、顧問公司、雲端平台都在往這方向走。因為只要模型還會吃 prompt,prompt 就一定是系統的一部分,不可能永遠靠個人手感撐場面。

下一步該怎麼做

如果你現在就在做 AI 產品,我會建議你先別追新模型。先把 prompt 當成資產管理。每個 prompt 都要有用途、格式、測試案例,還要有負責人。這很土,但很有效。

我的預測很直接。接下來 12 個月,更多團隊會把 prompt template、prompt QA、內部風格指南放進 release 流程。誰先做,誰就比較少花時間修爛答案,也比較容易比較不同模型。

所以真正的問題不是「prompt engineering 重不重要」。而是你還要不要繼續靠臨場發揮。還是現在就開始把 prompt 當成系統的一部分,認真做標準。