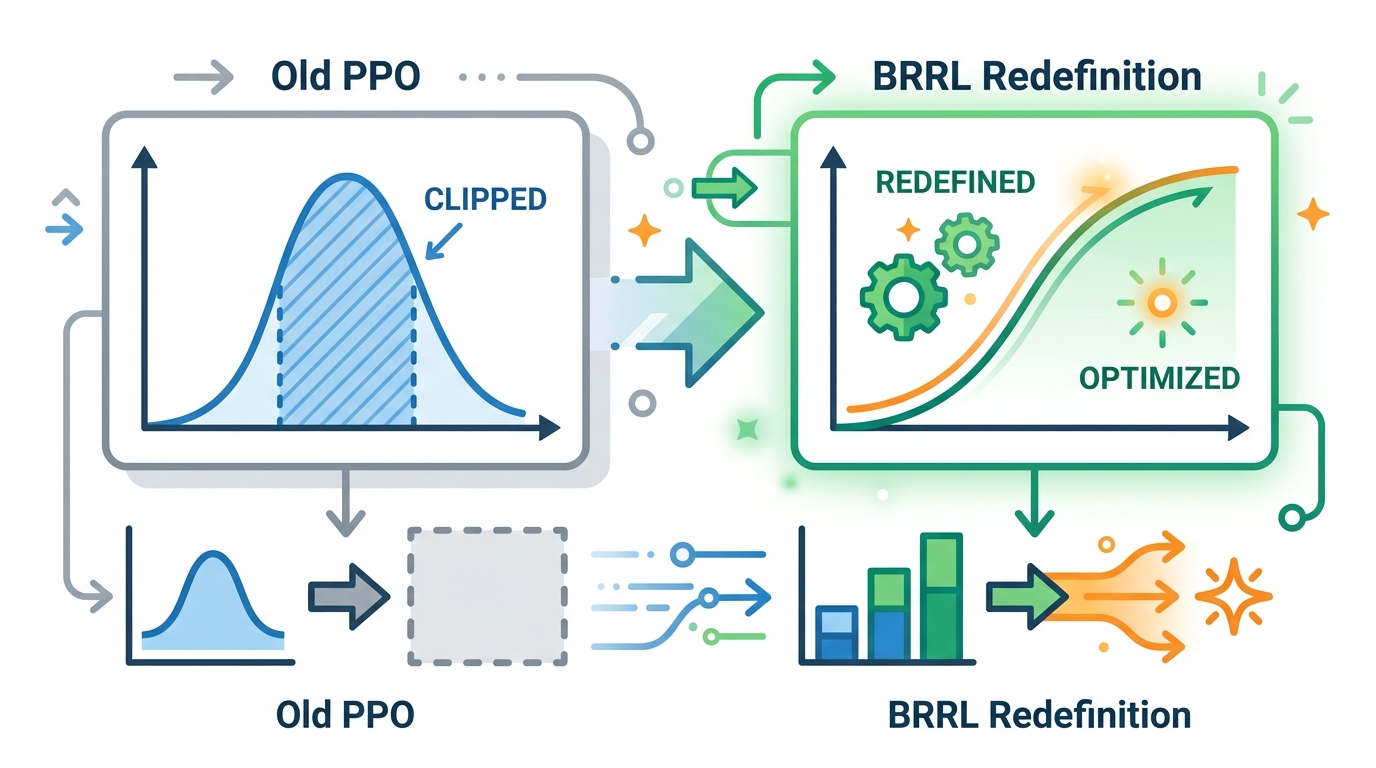

BRRL 重新定義 PPO 剪裁目標

BRRL 把 PPO 的剪裁目標改寫成有界比例框架,推出 BPO 與 GBPO,主打更穩定的更新與更清楚的理論基礎。

強化學習圈對 PPO 不陌生。它好用、穩、也常被直接拿來當預設方案。問題是,PPO 最常被提到的 clipped objective,長年都像是一個很有效的經驗法則,但背後的理論故事不夠乾淨。這篇 arXiv 論文 Bounded Ratio Reinforcement Learning 想做的事,就是把這個「看起來像在控步幅」的想法,改寫成一個明確有界的 policy ratio 框架,再從這個框架推導出可用的最佳化方法。

這不是單純把 PPO 換個名字。作者的重點是,先把政策更新比例限制住,再談怎麼做最佳化。這樣做的好處,是能把原本比較像技巧的設計,拉回到一個比較完整的理論脈絡裡。對做控制、機器人、遊戲,或是 LLM fine-tuning 的開發者來說,這種「更新不要亂飆」的設計,通常比漂亮的公式更重要。

從摘要來看,這篇論文想補的是 PPO 理論與實作之間的落差。PPO 之所以成為 on-policy RL 的常用預設,不是因為它最漂亮,而是因為它常常真的能跑。可是在工程上,大家仍然會遇到同一個問題:如果你不知道這個 clip 到底在保護什麼、限制什麼,就很難精準判斷它在不同任務上為什麼有效、哪裡會失效、又該怎麼延伸。

這篇論文要解的痛點

作者看見的痛點很直接:PPO 的 clipped objective 雖然實用,但它和原本 trust region 的動機之間,理論連結不夠清楚。簡單講,大家知道它在「保守更新」,但不一定能很順地把它從理論一路推到實作。這對研究者是可惜,對工程師則更麻煩,因為你在調參、除錯、改架構時,少了一層可依賴的解釋。

這種落差在 RL 特別傷。因為 RL 系統本來就容易不穩,政策一旦更新太猛,訓練可能直接崩掉。尤其在昂貴環境裡,像是機器人控制或大型模型微調,能不能穩定前進,往往比單次分數高不高更關鍵。論文的出發點,就是把「穩定更新」這件事,從 heuristic 拉成有理論支持的 bounded ratio 設計。

摘要還提到一個有趣的脈絡:作者認為這個新框架能把 trust region policy optimization 和 Cross-Entropy Method 串起來。這代表它不是只想修補 PPO,而是想把幾種常見的保守更新思路,放進同一個結構裡理解。對熟悉傳統 RL 的開發者來說,這種統一視角很有價值,因為它可能讓你重新看待「控制政策移動幅度」這件事。

方法到底怎麼運作

這篇論文的核心名字是 Bounded Ratio Reinforcement Learning,簡稱 BRRL。顧名思義,它把 policy optimization 寫成一個帶有 regularization 與 constraint 的問題,而這個約束的重點,就是 policy ratio 必須是明確有界的。換句話說,作者不是從 PPO 的 clip 出發,再去補理論;而是先定義一個有界比例的目標,再從那個目標推導出解析解。

這個解析解很重要,因為摘要明確說它能保證 monotonic performance improvement。白話一點,就是在論文的假設下,理想化的更新步驟不應該讓表現變差。這種性質對 RL 很吸引人,因為它比「大多數時候有效」更接近一個可依賴的安全網。當然,這是理論層面的保證,不代表所有實作情境都自動安全,但它至少把方向說清楚了。

問題在於,實際模型通常是 parameterized policy,你不可能真的直接套用那個解析最佳解。為了解這個落差,作者提出 Bounded Policy Optimization,也就是 BPO。BPO 的角色,是去最小化 current policy 與解析最優解之間的 advantage-weighted divergence。這讓 BPO 成為 BRRL 的實作版本,也就是說,理論給出目標,BPO 負責把它變成能訓練的演算法。

摘要還提到,作者為這個學到的 policy 建立了一個 expected performance 的下界,而且這個下界可以用 BPO loss 來表示。這對工程師來說很實際,因為它意味著 loss 不只是訓練訊號,而是和效能界限綁在一起。雖然摘要沒有展開完整推導,但這種設計通常代表作者希望你在優化時,不只是看 loss 降了沒,而是把它理解成一種有理論意義的進步指標。

如果要用最白話的方式總結方法,可以拆成三層:

- BRRL:先把 policy ratio 明確限制住,建立理論框架

- BPO:把這個框架變成可訓練的實作方法

- GBPO:把同樣思路延伸到 group-relative 的 LLM fine-tuning

其中 GBPO 是這篇論文對語言模型訓練最直接的延伸。摘要沒有把它寫成全新問題,而是把它放在同一個 bounded-ratio 思路裡,顯示作者想處理的不是單一任務,而是一整類需要保守更新的 policy optimization 場景。

論文實際證明了什麼

從理論面看,這篇論文至少做了三件事。第一,它推導出 bounded-ratio formulation 的解析最佳解。第二,它證明這個解析解具有 monotonic performance improvement。第三,它為 BPO 導出的 learned policy 建立 expected performance lower bound。這三件事合起來,就是作者想說明:PPO 那種保守更新的直覺,不只是能用,還可以被寫成更清楚的數學形式。

論文也主張,BRRL 提供了一個新的理論視角,用來理解 PPO loss 為什麼有效。這點很重要,因為 PPO 在實務上太常見了,反而常被當成理所當然。很多團隊會直接用它,但不一定能清楚回答:為什麼 clip 會幫助穩定?為什麼某些任務上它比其他方法更不容易炸?BRRL 的企圖,就是把這層模糊地帶往前推一步。

在實驗描述上,摘要列出的範圍不小。作者評估了 BPO 在 MuJoCo、Atari,以及更複雜的 IsaacLab 環境上,包含 Humanoid locomotion。GBPO 則被拿去做 LLM fine-tuning。這代表作者不是只在單一類型任務上試水溫,而是想看這套 bounded-ratio 思路能不能跨越經典控制、遊戲、機器人與語言模型。

不過,這裡也要講清楚限制:摘要沒有公開完整 benchmark 數字,所以我們看不到具體分數、誤差、樣本效率或訓練成本。也就是說,這篇摘要能讓你知道「有做哪些實驗、結果大方向如何」,但不能讓你直接比較各方法之間差多少。現階段能安全下的結論,只能是作者聲稱 BPO 和 GBPO 一般來說能和 PPO、GRPO 持平或更好,尤其在 stability 和 final performance 上。

這種表述方式也很值得注意。一般來說,說「generally match or outperform」並不等於全面碾壓。它比較像是:在作者測過的任務裡,整體趨勢是正面的,但還不能從摘要看出哪個環境最強、哪個環境最弱、是否存在明顯失敗案例。對研究新聞來說,這種保守解讀比過度延伸更重要。

對開發者有什麼影響

如果你在做 RL 系統,這篇論文最直接的價值,不是多一個名詞,而是多一個更完整的更新控制框架。PPO 好用,但很多團隊其實是靠經驗調 clip、學習率、batch 設定來維持穩定。BRRL 的提案,等於是把「不要更新太猛」這件事,變成一個有界比例的正式目標。對需要反覆 debug 的工程團隊來說,這種理論清楚度很有吸引力。

對 LLM fine-tuning 而言,GBPO 值得特別關注。摘要明確提到它是 group-relative extension,目標場景和 GRPO 類似。若你正在做對齊、偏好最佳化,或任何需要保守 policy 更新的語言模型訓練,這類方法的吸引力通常在於:它可能保留穩定性,同時提供更容易分析的目標函數。當然,摘要沒有給出實作細節,所以還不能判斷它的工程複雜度高不高。

但這篇論文目前也有明顯限制。摘要沒有交代超參數敏感度、額外計算成本、實作開銷,也沒有 ablation 或失敗案例。這些資訊缺失,會讓人很難知道它在真實專案裡是不是值得換掉現有流程。尤其在 RL,理論漂亮不一定代表部署容易;有時候多一層約束,就會帶來額外調參負擔。

所以,對開發者來說,這篇論文比較像是「值得跟進的理論型更新」,而不是可以立刻照抄的 production recipe。它的價值在於,幫 PPO-style optimization 提供一個更乾淨的解釋,並且把穩定更新這件事講得更有結構。如果你正在找一個能把 trust region、PPO、甚至 CEM 放進同一個視角的框架,BRRL 是值得放進閱讀清單的。

OraCore 的簡短結論

這篇論文做的事,可以濃縮成一句話:它把 PPO 的 clipped objective 重新包裝成一個有界比例的理論框架,然後推出 BPO 與 GBPO,試圖在控制、機器人與 LLM fine-tuning 裡,提供更穩定也更有理論感的政策更新方式。

它真正強的地方,不是摘要裡那些看起來很熟悉的 RL 關鍵字,而是它嘗試把「實務上有效」和「理論上說得通」這兩件事接起來。它還沒給出完整 benchmark 細節,所以不能過早下定論,但如果你在意 policy update 的穩定性,這篇確實值得追。

對台灣開發者來說,這類工作最有意思的地方在於,它不只是另一個 RL trick,而是在問:我們能不能把大家早就習慣的 heuristic,變成更可解釋、可推導、也更容易延伸的系統方法。BRRL 的答案是「可以試試看」。