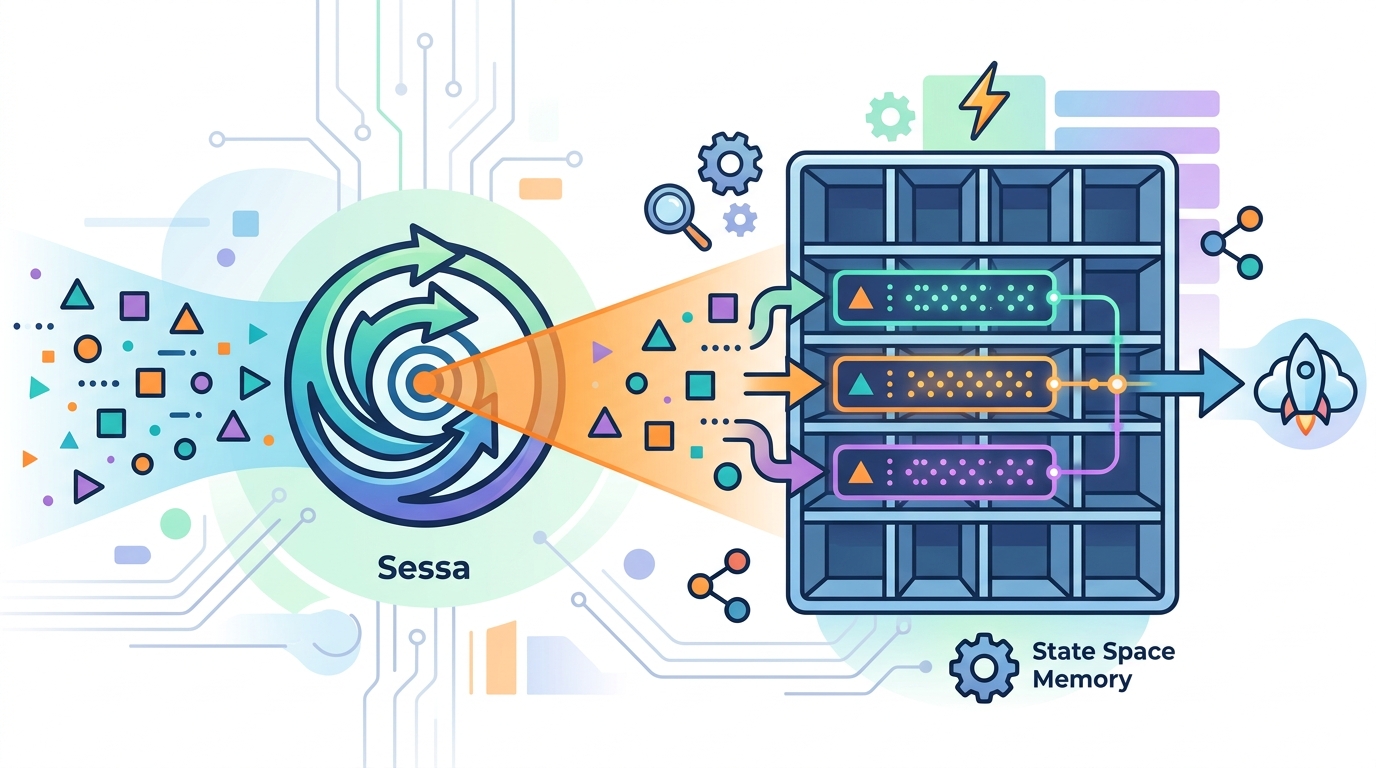

Sessa 把注意力放進狀態空間記憶

Sessa 把 attention 放進 state-space 的回饋路徑,想同時保留長上下文檢索與穩定記憶。摘要主打 power-law 記憶尾巴,並宣稱長上下文 benchmark 表現領先。

現代序列模型常卡在一個老問題:你要嘛選 Transformer 的直接回看,要嘛選 state-space model 的高效率傳遞,但兩邊都不完美。前者能看見很長的上下文,卻容易因為注意力太分散,讓舊 token 的影響被稀釋;後者傳遞資訊很省算力,卻可能在長距離後快速失去敏感度。Sessa: Selective State Space Attention 想做的,就是把這個兩難拆開重組。

這篇摘要的核心訊息很直接:不要把 attention 當成一次性的查詢,而是把它放進回饋路徑裡,讓模型在時間推進時,還能持續挑選、混合、更新記憶。對做長上下文系統的開發者來說,這不是抽象的架構辯論,而是很實際的問題:怎麼讓舊資訊不會太快失效,又不用為了超長上下文付出整個巨型 attention window 的代價。

這篇論文在修什麼痛點

摘要先從 attention 的弱點切入。當 retrieval 不夠 sharp,注意力會變得很 diffuse,某個 token 的影響就會被平均掉。摘要用有效支撐集合大小 S_eff(t) 來描述這件事,意思是模型實際上雖然「看得到」很多位置,但真正分到單一 token 的權重可能很少。若是 full-prefix 的情境,老 token 的影響還可能掉到 O(1/ℓ),其中 ℓ 是距離現在的 lag。

這種衰減對長上下文任務很傷。模型不是完全忘記,而是記得太淡。對使用者來說,結果常常就是:前面明明提過的條件,到了後面卻像沒說過一樣。摘要想解的,就是這種「看得到但不夠有用」的記憶稀釋問題。

另一邊,structured state-space model 的問題則不同。它們靠顯式的 feedback path 做 recurrent 傳遞,效率好很多;Selective 版本像 Mamba 還會讓回饋依輸入而變動,這確實更彈性。但摘要指出,當 freeze time 無法在長時間內維持時,長距離敏感度仍會以指數方式衰減。也就是說,這類模型雖然能傳很遠,但傳到後面還是可能變鈍。

所以 Sessa 的定位,不是再做一個「更大的 Transformer」或「更快的 state-space」。它要補的是架構層級的缺口:Transformer 偏向一次讀取,state-space 偏向單一回饋鏈;Sessa 則想把注意力嵌進回饋過程,讓模型同時有檢索與持續更新的能力。

Sessa 到底怎麼運作

摘要裡最關鍵的一句話,是它把 attention 放進 feedback path。白話一點說,就是 attention 不再只是對過去做一次查找,而是變成記憶傳遞機制的一部分。模型在往前走的同時,也在用 attention 決定哪些資訊值得被帶著走。

摘要把這種設計描述成「recurrent many-path aggregation within a layer」。這個說法很學術,但意思其實不難懂:資訊不是只能沿著單一路徑往前傳,而是能在同一層裡經由多條路徑被蒐集、混合、再送出去。這讓模型在保留舊訊號時,不必死守單一記憶槽。

在理論上,摘要給出的結果是 power-law memory tail,對 lag ℓ 的衰減階數是 O(ℓ^-β),而且 β 的範圍是 0 < β < 1。這個細節很重要,因為它代表老資訊的影響衰減得比 O(1/ℓ) 還慢。換句話說,記憶不是一下子掉光,而是拖得更久,能在更長的時間尺度上維持可見度。

摘要還補了一個更強的說法:在明確的 diffuse uniform-routing 設定下,這個 rate 是 tight 的,影響會是 Θ(ℓ^-β)。這表示它不是只給出一個鬆散上界,而是說在某個具體路由情境裡,這種 power-law 行為真的會出現,而且跟理論預測對得上。

論文實際證明了什麼

這份摘要提供的證據分成兩塊:理論分析和實驗結果。理論上,它主張 Sessa 可以實現 power-law memory tails,而且這種衰減比 full-prefix attention 那種 O(1/ℓ) 的老 token 行為更慢。這代表它不是只在「短時間內比較會記」,而是試圖改變記憶隨距離衰減的形狀。

摘要還說,在同樣條件下,只有 Sessa 在比較的模型類別裡,能實現 flexible selective retrieval,包含 non-decaying profiles。這句話的分量不小。它不只是說 Sessa 記得比較久,而是說它能根據任務需要,調整保留曲線,甚至出現不衰減的型態。對架構設計來說,這是可表達性上的主張。

實驗部分,摘要說在 matched architectures 與 training budgets 下,Sessa 在長上下文 benchmark 上拿到最強表現,同時在短上下文語言模型任務上,仍能和 Transformer 與 Mamba 類 baseline 保持競爭力。這是很有意義的訊號,因為很多長上下文模型常見的問題,就是長文表現上去後,短文能力跟著掉。

但這裡也有明確限制:摘要沒有公開 benchmark 名稱,也沒有給出任何數字。也就是說,這篇摘要沒有公開完整 benchmark 細節。你目前只能知道它宣稱「表現最好」,卻還不能從摘要判斷領先幅度、任務組成、評估方式,或是不是特定超參數帶來的結果。

對開發者有什麼意義

如果你在做長上下文助理、檢索型 agent、文件摘要、程式碼理解,或任何需要跨很多 token 保持狀態的系統,這篇論文的價值不在於它是不是又一個新名詞,而在於它提供了一條不同的設計路線。它提醒我們,長距離記憶不一定只能靠更大 attention window,也不一定只能靠更深的 recurrent 傳遞。

真正實用的模型,通常要同時解兩件事:第一,哪些資訊值得被留下;第二,留下之後能撐多久。Sessa 的想法是把這兩件事綁在同一個回饋機制裡。這讓它在概念上更接近「可選擇地記住」,而不是單純「盡量記住」。

對工程端來說,這種設計如果真的成立,可能代表長上下文模型不必只靠暴力擴窗來換記憶。它也可能讓某些任務在不犧牲短上下文語言能力的前提下,獲得更穩的跨段落依賴追蹤。不過,摘要沒有提供推論成本、延遲、記憶體占用或實作複雜度,所以現在還不能直接推論它在 production 的代價。

換句話說,Sessa 目前比較像一個值得注意的架構方向,而不是可以立刻替換現有系統的現成答案。它的訊號是:如果你的工作負載很在意長距離依賴,attention 和 state-space 可能不必二選一。

限制、空白與還不能下的結論

只看摘要,這篇論文還有不少關鍵資訊沒揭露。它沒有給 benchmark 名稱、資料集、模型規模、參數量、訓練成本,也沒有說推論速度如何。對實作的人來說,這些資訊都很重要,因為長上下文模型的價值,往往要和算力成本一起看。

另外,理論上的 power-law memory tail 很吸引人,但理論記憶形狀不等於真實任務表現。模型能不能更會找回關鍵片段、能不能在複雜推理裡維持一致性、能不能在不同領域都穩定,摘要都還沒回答。也就是說,這篇摘要展示的是方向感,不是最終結論。

不過,從研究脈絡來看,Sessa 的重點很清楚:如果 attention 太分散、state-space 又衰減太快,那就把 attention 放進 recurrence 裡,讓記憶的路徑變得可選擇、可調整,也更耐久。這不是小修小補,而是試著重新定義序列模型裡「記憶」的運作方式。

- Transformer 的優勢是直接回看過去,但舊資訊容易被注意力稀釋。

- Selective state-space 的優勢是高效率回饋,但長距離敏感度仍可能快速下降。

- Sessa 想把 attention 變成回饋機制的一部分,目標是兼顧選擇性檢索與較慢的記憶衰減。

如果你正在觀察下一代長上下文架構,這篇值得放進清單。摘要已經給出理論上的記憶尾巴主張,也宣稱在長上下文 benchmark 上有最強表現;只是因為缺少完整數據,現在更適合把它視為一個強烈訊號,而不是已經定案的標準答案。