隨機神經網路的三態漲落相變

這篇理論論文分析無限寬隨機神經網路的高深度極限,指出其函數泛函會因 covariance 固定點而出現三種不同收斂型態。

深度神經網路的研究,很多時候都在談訓練、準確率、或 scaling law。但這篇論文換了一個角度,去看更基礎、也更偏理論的問題:當一個無限寬的隨機神經網路越疊越深時,它的輸出函數泛函,最後會長成什麼樣子。

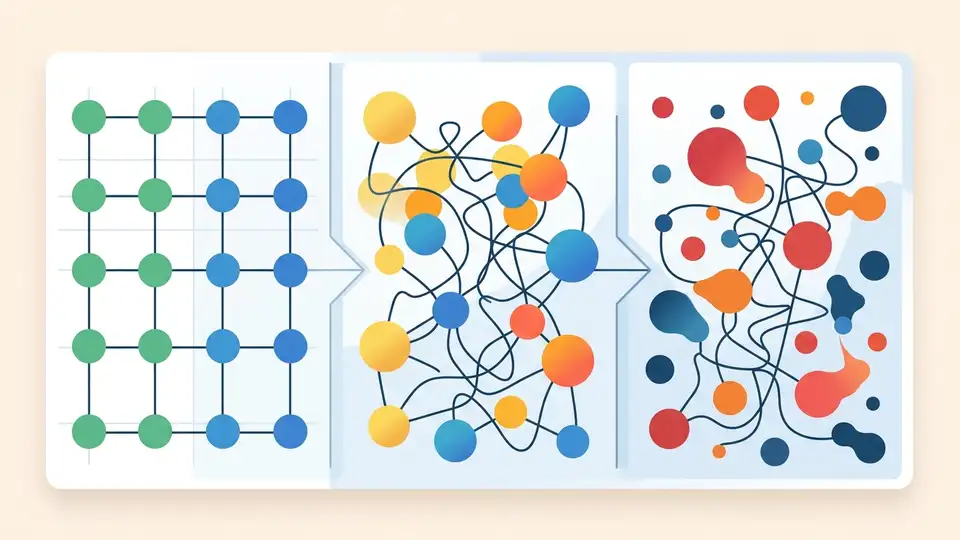

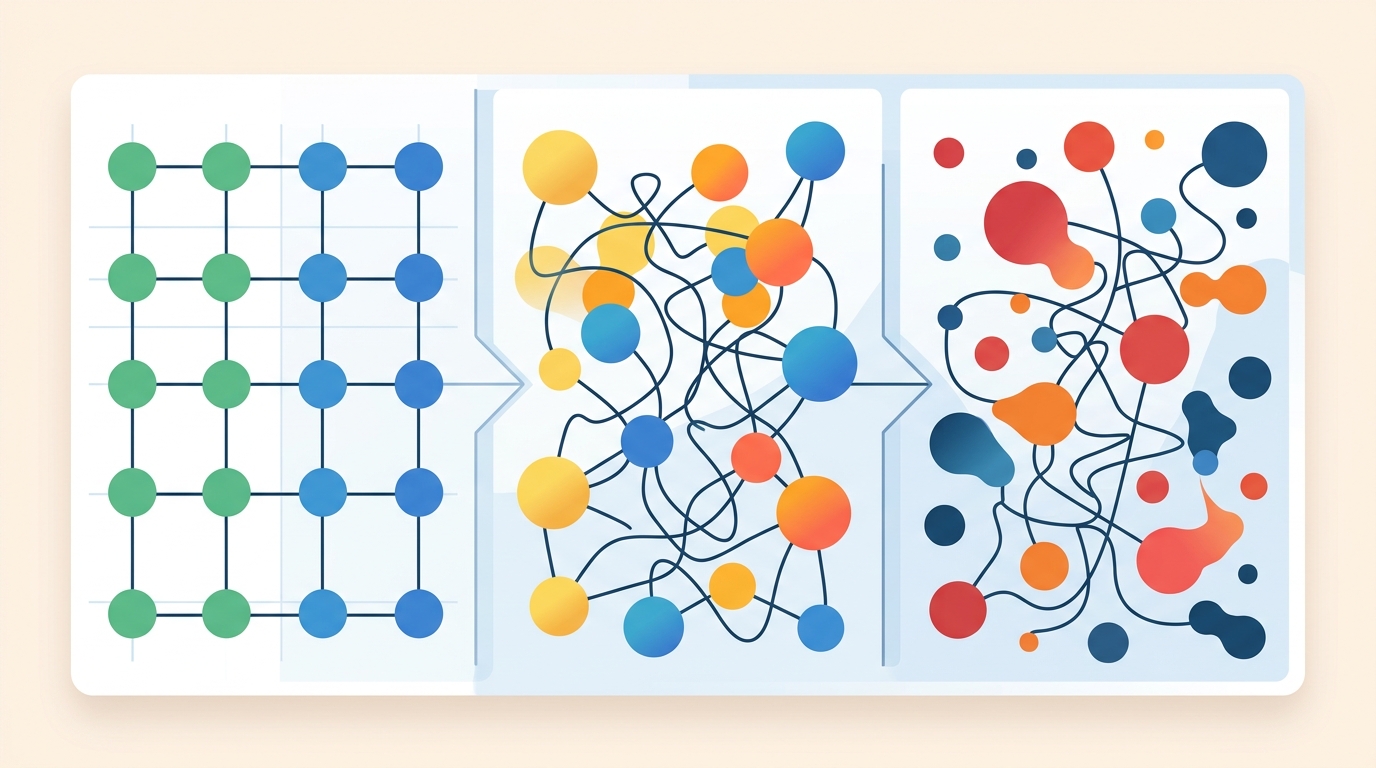

答案不是單一路徑。論文指出,這些漲落會落入三種不同的極限行為,而且分界點不是靠經驗法則,而是由 covariance function 的固定點結構來決定。這代表深度本身就可能觸發相變,而不是只是讓模型「更複雜」而已。

本文對應的論文是 Phase Transitions in the Fluctuations of Functionals of Random Neural Networks。它研究的是定義在 d 維球面上的無限寬隨機神經網路,重點放在深度增加時,輸出高斯場相關泛函的極限分布會如何改變。

這篇論文在解什麼痛點

隨機神經網路常被拿來當理論工具,用來理解深度、寬度、與訊號傳遞之間的關係。當寬度趨近無限時,很多輸出可以被近似成高斯對象,分析會變得比較乾淨。但一旦你往下看「輸出之上的泛函」,也就是不只看點值,而是看某種整體統計量,事情就沒那麼單純。

這篇論文想回答的問題很直接:當深度一直增加時,這些泛函到底會收斂到什麼分布?是一般的高斯極限?是某個由極限高斯場所決定的函數?還是更非典型的非高斯極限?

作者把這件事描述成 phase transition,也就是相變。意思是說,同一個隨機網路設定,因為 covariance map 的固定點性質不同,最後可能走向完全不同的統計極限。這種觀點對理論上很重要,因為它提醒我們:深度不是只有「多一層」這麼簡單,它可能改變整個極限世界。

方法到底怎麼運作

這篇論文的核心,不是在設計新架構,而是在分析 covariance function 與其反覆迭代後的行為。作者指出,深度增加時,covariance 會一層一層經過同一個 operator 的作用,而這個 operator 的固定點,決定了系統最後會落在哪一種極限。

更白話一點說,整個故事的主角不是某個單一神經元,也不是 loss,而是「共變異數怎麼被深度推著走」。如果固定點是穩定的,漲落的型態就會跟著穩定下來;如果固定點不穩,極限行為就可能換成另一種 regime。論文就是把這個固定點結構,當成整個相變現象的分類器。

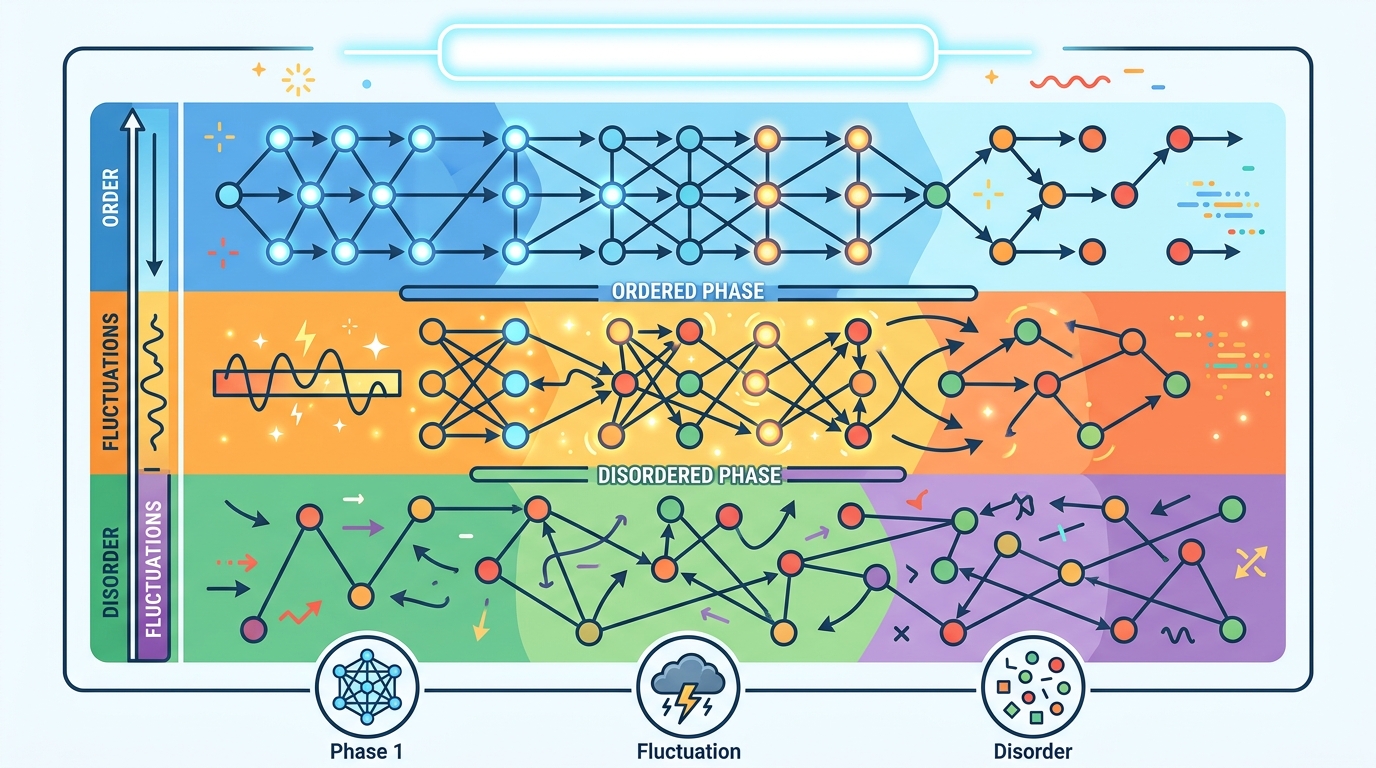

根據摘要,作者整理出三種不同的極限結果:

- 收斂到某個極限高斯場的同一個泛函;

- 收斂到高斯分布;

- 收斂到 Qth Wiener chaos 裡的分布。

這三種結果的差別很關鍵。第一種表示你看到的是極限高斯場上的某個穩定函數型態;第二種是大家最熟的中心極限定理式高斯收斂;第三種則代表你進入了非高斯極限,但不是亂掉,而是落在一個很具體的高階隨機結構,也就是 Wiener chaos。

為了證明這些結果,作者用到 Hermite expansions、Diagram Formula、以及 Stein-Malliavin techniques。這些都不是新工具,但組合方式有新意。真正的創新,在於把這些機率論與隨機分析工具,接到 covariance 迭代的固定點分析上,讓深度行為和極限分布之間建立明確對應。

換句話說,這篇論文不是在說「深度越深就越難分析」,而是在說「深度越深時,分析的關鍵變數是固定點與穩定性」。只要你抓到 covariance map 的動態,就能預測最後是哪一種極限。

論文實際證明了什麼

摘要明確指出,作者證明了 central limit theorem 與 non-central limit theorem 兩類結果。這表示他們不只證明某些情況下會得到高斯極限,也證明了在其他情況下,極限會偏離高斯,而且偏離得有結構,不是隨機噪音式的失控。

論文最重要的實際結論,是深度增加時的極限行為,會「顯著依賴」covariance operator 的固定點。這就是所謂的 phase transition:不是所有設定都共享同一個深度極限,而是會因為固定點的性質不同,分裂成不同的統計區域。

摘要沒有公開完整 benchmark 細節,也沒有實驗數字、準確率、或 runtime 比較。這很正常,因為這是一篇理論論文,重點在數學結構,不在實作表現。你在這裡看不到模型在某個資料集上的分數,而是看到一個更底層的結果:隨機深層網路的漲落極限,並不是單一模板。

另一個值得注意的點,是非高斯極限不是模糊地說「不再像高斯」。摘要明確寫到,它收斂到 Qth Wiener chaos 中的分布。對熟悉機率論的人來說,這是一個很具體的高階極限類別,表示系統進入的是某種有結構的非高斯世界,而不是完全失去可分析性。

對開發者和研究者有什麼影響

雖然這篇不是應用型 ML 論文,但它對做理論分析的人很有參考價值。尤其是那些在看 infinite-width approximation、random initialization theory、或 kernel limit 的人,這篇論文提供了一個很重要的提醒:深度的極限,不一定只有一種高斯答案。

這件事會影響你怎麼理解穩定性、訊號傳遞、以及輸出統計。很多時候,我們會直覺以為只要寬度夠大,系統就會靠近高斯世界;但這篇論文說,還要看 covariance fixed points 怎麼長。固定點穩不穩,可能比「夠不夠寬」更直接地決定最後的極限型態。

對工程實作來說,這不代表你要立刻改架構,而是要更小心地看理論近似的適用範圍。當你拿隨機網路或其高斯近似來做分析時,要先問:這個模型的深度動態,會不會把你帶進另一個 regime?如果會,那些原本依賴高斯假設的推論,就不一定還成立。

這也延伸出一個更廣的觀念:研究深層模型時,重點不只是「網路有多寬」,而是「架構誘發了什麼樣的迭代系統」。在這篇論文裡,那個迭代系統是 covariance operator。換到其他脈絡,可能是 kernel map、activation recursion,或其他 function space 裡的動態。

限制與還沒回答的問題

這篇論文最大的限制,也正是它的研究邊界:它處理的是定義在 d 維球面上的無限寬隨機神經網路。這是一個非常乾淨的理論設定,但它和真實世界裡的有限寬、已訓練、而且常常帶有資料偏差的模型,還是有距離。

摘要沒有交代完整的架構細節,也沒有把所有假設條件展開。像是具體研究了哪些 functionals、每個 regime 的精確成立條件是什麼、以及不同固定點的穩定性如何判定,這些都不是摘要層級能完整看見的。對想把結果轉成實作準則的人來說,這些細節會很重要。

另外,這種 fixed-point-driven 的相變圖像,是否能直接推廣到其他資料域、其他 activation、或非高斯權重初始化,摘要也沒有說。也就是說,這篇論文提供了非常清楚的理論地圖,但它還不是一份可直接套用的工程手冊。

不過,這份地圖還是很有價值。因為它把一個常被簡化成「深度越深,行為越趨近某個極限」的故事,拆成了多個 regime。這對做理論近似的人來說,是一個實用提醒:你手上的極限,不一定是唯一的極限;它可能取決於 covariance dynamics 的固定點結構。

總結來說,這篇論文的重點不是提出新模型,而是把隨機神經網路的深度漲落,整理成一個有相變、有固定點、也有不同極限分布的完整圖景。對台灣的 ML 研究者或想理解深層隨機模型的人來說,這是一篇很典型的理論工作:不直接給產品,但會改變你看待深度網路極限行為的方式。