邊界不穩定為何反而更會泛化

這篇論文把高學習率下的混沌訓練,連到泛化能力,並用 Hessian 光譜定義新的 sharpness dimension。

現代神經網路常常不是在「穩穩收斂」下訓練,而是把學習率推到穩定邊界附近。這時候,loss 曲線可能抖、參數軌跡可能亂,甚至看起來像混沌。但這篇論文想說的是:這種看似不安分的訓練狀態,可能正是模型泛化好的原因之一。

論文是 Generalization at the Edge of Stability。它不是在講一個新的訓練技巧,而是在補一個大家早就看得到、卻一直說不清楚的理論缺口:為什麼某些大學習率、甚至帶點不穩定的訓練流程,最後反而能得到更好的測試表現。

這篇摘要沒有公開完整 benchmark 細節,所以我們不能從這份 raw 資料直接推論它在某個資料集上贏了多少、誤差多少,或具體提升幅度有多大。它能確定的是:作者提出了一套新的理論語言,去描述 edge-of-stability 這種訓練現象,並且把它和 generalization 綁在一起。

這篇論文想解什麼痛點

深度學習裡有個很常見的矛盾:訓練過程看起來不穩,結果卻可能更會泛化。尤其在大學習率下,優化不一定會乖乖掉進單一收斂點,反而可能出現振盪、混沌,甚至長時間都不會「安靜下來」。這種現象就是論文裡說的 edge-of-stability regime。

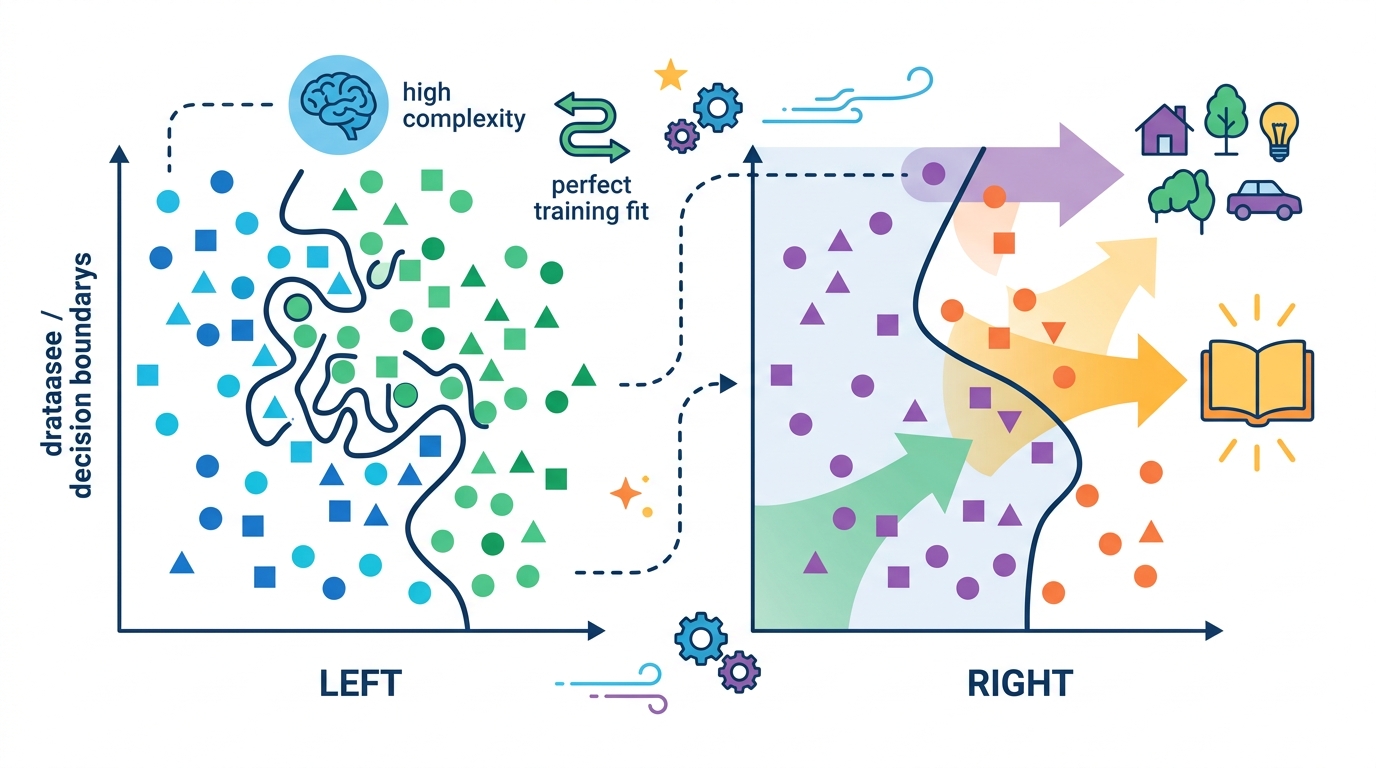

問題在於,過去很多解釋泛化的方式,會拿 Hessian 的 trace 或 spectral norm 這類簡化指標來看曲率。這些指標不是沒用,而是太粗。它們把很多方向上的資訊壓成少數幾個數字,結果很容易漏掉真正重要的幾何結構。

對工程師來說,這件事很實際。因為平常調模型時,大家常常在學習率、batch size、optimizer、scheduler 之間做折衷。你會看到某些設定訓練過程很「吵」,但最後 test 表現卻不差。這篇論文的核心就是:這種現象可能不是偶然,而是有一套可描述的幾何與動力系統結構。

方法到底怎麼運作

作者先把 stochastic optimizer 看成隨機動力系統。這個視角很重要,因為它不再假設訓練一定會收斂到某個單點參數,而是允許系統最後落在一個 attractor set。更進一步,在他們研究的區域裡,這個 attractor 甚至可能帶有 fractal-like 的結構。

接著,論文借用 Lyapunov dimension theory 的直覺,提出一個新的量,叫做 sharpness dimension。名字已經透露重點:它不是只看「尖不尖」,而是看 sharpness 跟訓練動態怎麼互相作用。也就是說,模型是不是泛化得好,不只取決於某一個曲率數值,而是取決於整個曲率結構。

這裡最關鍵的地方,是作者強調要看完整的 Hessian spectrum,以及 partial determinants 的結構。白話一點說,trace 或 spectral norm 只能告訴你整體或最極端的曲率,但無法告訴你每個方向的曲率怎麼分布。可是在 edge-of-stability 這種情況下,方向性資訊很可能才是主角。

所以這篇論文的思路不是「訓練亂掉了,所以出問題」,而是「訓練的長期行為本來就可能是複雜吸引子,而這個吸引子的幾何大小,會反映在泛化上」。sharpness dimension 就是作者拿來量這件事的工具。

論文實際證明了什麼

這篇論文的主結果,是建立了一個以 sharpness dimension 為基礎的 generalization bound。也就是說,它不是只提出一個直覺,而是把這個直覺寫成可推導的理論上界。摘要明確指出,這個泛化界依賴的是完整 Hessian spectrum,以及 partial determinants 的結構,而不是只看單一統計量。

這點很重要。因為如果你只看 trace 或 spectral norm,很容易把不同模型、不同訓練動態混為一談。作者的主張則更細:在 chaotic regime 裡,真正影響泛化的是更完整的曲率資訊。換句話說,模型不是只在「平不平」這個單一維度上被描述,而是要看整個光譜形狀。

摘要也提到,作者用各種 MLP 和 transformer 做實驗,驗證了理論,並且對 grokking 這個現象提供了新的理解。grokking 指的是模型在長時間訓練後,會突然從泛化很差跳到泛化很好的狀態。這篇論文把它和 edge-of-stability 的理論連起來,暗示這種突然轉變可能和訓練動力的幾何有關。

不過,這裡也要講清楚限制:摘要沒有提供完整 benchmark 數字、資料集名稱、訓練設定,或具體提升幅度。所以我們可以說它在 MLP 和 transformer 上做了驗證,但不能從這份資料直接判斷效果有多大、跨多少任務、或是否能外推到更大規模模型。

這對開發者有什麼影響

如果你平常在調神經網路,這篇論文最直接的啟發是:不穩定不一定是壞事。當學習率拉高、訓練看起來有點亂時,這不代表模型一定訓練失敗。相反地,在某些條件下,這種 edge-of-stability 狀態可能就是泛化能力形成的一部分。

這也會改變你看訓練過程的方式。很多人習慣只盯 loss、gradient norm,或某個簡化過的 sharpness 指標。但如果這篇論文的思路是對的,那些訊號都可能太粗,只看得到表面,沒看到真正決定 generalization 的幾何結構。

對做 optimizer、訓練分析、或模型 scaling 的人來說,這代表未來可能需要更細的 spectral 工具。尤其當模型訓練在穩定邊界附近時,單一最大特徵值或平均曲率,可能不足以描述整個訓練行為。你得看的是更完整的 Hessian 光譜,而不是只看一個摘要數字。

另外,這篇論文也提醒一件事:我們在實務上常把「穩定」當成好事,但在深度學習裡,穩定和泛化不一定是同義詞。某些看起來很鬆動、甚至很混沌的訓練路徑,最後反而可能走到更好的解。

還有哪些限制與未解問題

第一個限制很直接:摘要沒有公開完整實驗細節。也就是說,我們不知道它怎麼量 sharpness dimension、計算成本多高、能不能直接套到超大模型,或在實務訓練流程裡是不是容易落地。

第二個限制是,理論和工程之間還有一段距離。就算 generalization bound 成立,也不代表工程師立刻知道該怎麼調 learning rate,何時會進入 grokking,或怎麼在訓練中即時監控這個狀態。這篇論文比較像是把方向指出來,而不是把工具箱整包交給你。

第三個問題是可操作性。完整 Hessian spectrum 和 partial determinants 聽起來很強,但實際上要不要算、怎麼算、成本是否可接受,這些都還需要更多資訊。摘要沒有回答這些問題,所以我們只能說它提出了一個更精細的理論框架,而不是一個現成的 production recipe。

即便如此,這篇論文還是有價值。因為它把一個大家常看到、卻很難解釋的現象,從「訓練亂掉」改寫成「動力系統在高學習率下進入另一種幾何狀態」。這個視角一旦成立,很多原本看起來像例外的訓練行為,就可能變成理解 generalization 的關鍵線索。

- 作者把 stochastic optimizer 建模成 random dynamical system。

- 提出新的 sharpness dimension,靈感來自 Lyapunov dimension theory。

- 建立依賴 sharpness dimension 的 generalization bound。

- 強調完整 Hessian spectrum 和 partial determinants,比 trace 或 spectral norm 更關鍵。

- 摘要提到在 MLP 與 transformer 上驗證,並連到 grokking 現象。

總結來說,這篇論文不是在鼓勵大家盲目把 learning rate 開大,而是在提醒:訓練不穩定和泛化能力之間,可能存在結構性的關係。對開發者來說,這代表 edge of stability 不只是要避開的風險區,也可能是理解模型為何會學得更好的入口。