AVISE 模組化測 AI 安全漏洞

AVISE 是一個開源 AI 安全評估框架,主打模組化漏洞測試。論文用 25 個 jailbreak 測試案例與自動判定流程,驗證 9 個模型都能被攻破。

AI 系統開始進入更敏感的工作流程,但「怎麼測它會不會被打穿」這件事,工具還沒跟上。AVISE: Framework for Evaluating the Security of AI Systems 想補上這個缺口。它提出一套模組化、開源的安全評估框架,用來找出 AI 漏洞,並把安全測試做成可重複的流程。

這篇論文的重點,不是再做一個單次攻擊腳本而已,而是想把 AI 安全測試變成工程化工作。對開發者來說,這很直白:如果你正在上線或整合語言模型,就需要一種穩定的方法,去檢查某種 prompt 策略會不會把模型 jailbreak 掉。

它想解的痛點是什麼

論文一開始就把問題講得很清楚:AI 系統雖然已經被部署到高風險場景,但系統性的安全評估仍然不足。這不只是模型在 demo 裡講錯話而已。當漏洞出現在真實流程裡,後果可能是高調的 exploit,甚至是實際失效。

對工程團隊來說,這個缺口會直接影響上線節奏。若安全測試是臨時做、靠人工挑 prompt、每次方法都不一樣,那就很難比較不同版本的模型,也很難重現結果。更不用說把它做成內部流程,持續抓出弱點。

AVISE 的定位,就是把這件事變得更結構化。論文把它描述成一個可以用來「識別漏洞」與「評估安全性」的框架。換句話說,它不是單一 benchmark,也不是一次性的攻擊程式,而是想當成後續自動化安全測試的底座。

AVISE 到底怎麼運作

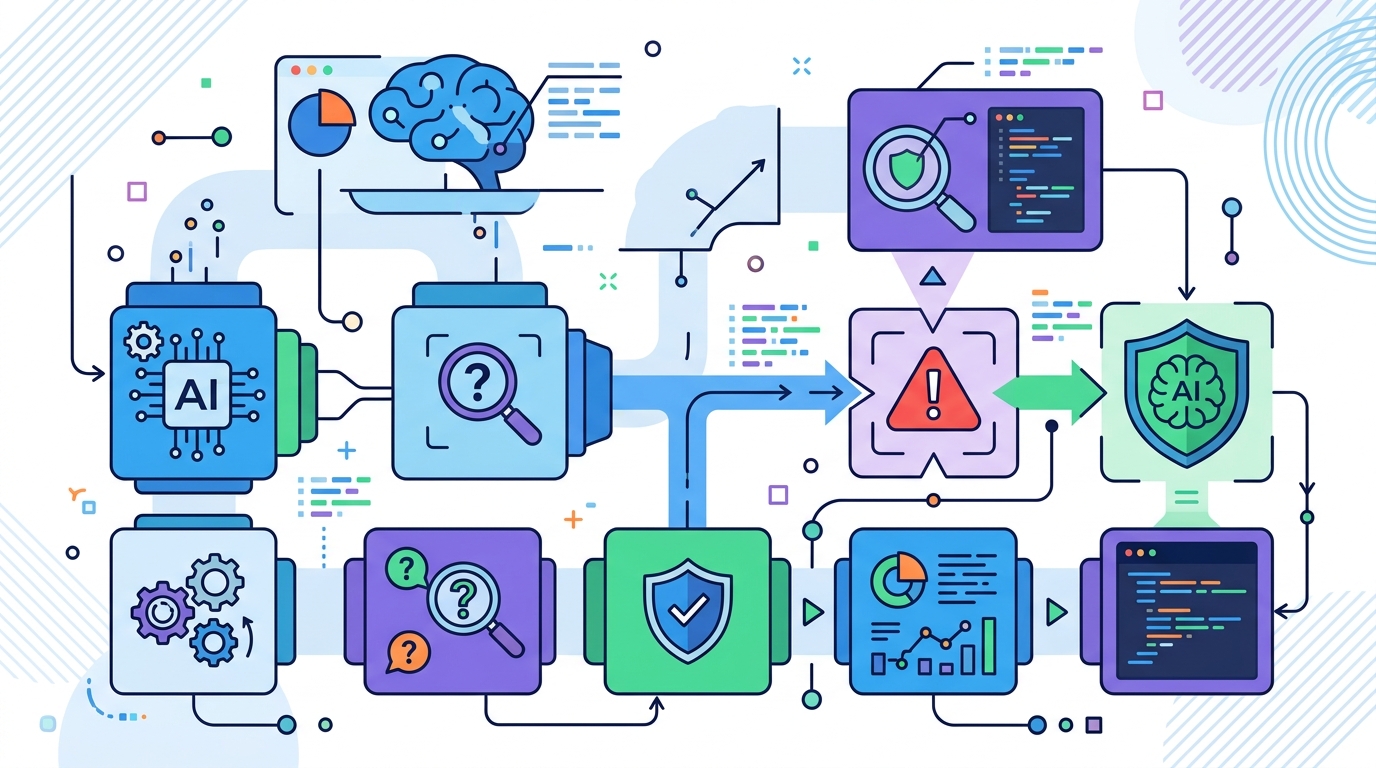

AVISE 是 AI Vulnerability Identification and Security Evaluation 的縮寫。論文把它定義成一個模組化的開源框架。這個設計方向很重要,因為它暗示使用者不會被鎖死在固定測法裡,而是可以把不同測試、不同評估元件接進去。

論文示範的攻擊路徑,是把一個基於 theory-of-mind 的 multi-turn Red Queen attack,延伸成一個 Adversarial Language Model,也就是 ALM 增強版攻擊。白話一點說,就是把原本多輪互動式的攻擊思路,改造成更自動化、也更適合拿來做語言模型安全測試的形式。

在這個攻擊之上,作者再建立了一個自動化的 Security Evaluation Test,也就是 SET,用來找出 jailbreak 漏洞。這個 SET 包含 25 個測試案例,另外還有一個 Evaluation Language Model,簡稱 ELM,負責判定某個測試案例到底有沒有成功 jailbreak 目標模型。

這個拆法很值得注意。攻擊生成和結果判讀被分開之後,整個流程就比較容易自動化,也比較容易重跑。對實務來說,這代表你可以把它更像一條測試管線,而不是一次性的紅隊演練。

從架構角度看,AVISE 想做的不是單點攻擊能力,而是把「找漏洞」和「判定漏洞是否成立」都納入同一套可重複流程。這也是它和一般只展示 prompt 攻擊技巧的研究,最大的差別。

論文實際證明了什麼

先講清楚一點:這篇摘要沒有公開完整 benchmark 細節,所以我們看不到完整的模型名單、每個模型的逐項成功率,也看不到 25 個測試案例的完整內容。摘要提供的,是框架示範與部分評估結果。

在這個示範裡,ELM 的表現是 92% accuracy、0.91 F1-score,以及 0.83 Matthews correlation coefficient。這三個指標放在一起看,比只看 accuracy 更完整,因為 F1 和 MCC 都能幫助理解分類判定是否穩定。

更重要的是,論文說 AVISE 被拿來評估九個近期釋出的語言模型,而且這九個模型都對這個增強版 Red Queen attack 顯示出脆弱性,只是程度不同。這是摘要裡最直接的實證結果。

也就是說,這篇研究不是在說「某個模型會被打穿」,而是指出:在這組測試與這個攻擊設定下,作者測過的九個模型全都不是無懈可擊。這個結論的範圍仍然受限於摘要提供的資訊,但它至少證明了這套測試流程能抓到實際的 jailbreak 弱點。

- AVISE 是模組化、開源的安全評估框架。

- 示範攻擊是 ALM 增強版的 multi-turn Red Queen attack。

- SET 內含 25 個測試案例。

- ELM 的成績是 92% accuracy、0.91 F1、0.83 MCC。

- 摘要指出 9 個受測模型全都存在脆弱性。

對開發者有什麼實際影響

如果你是做 LLM 產品、平台,或把模型嵌進既有服務的人,這篇論文最有價值的地方,不是攻擊名稱本身,而是它把安全評估變成可自動化、可版本化、可重跑的流程。

這件事很像一般軟體工程裡的測試文化。你不會只在發版前手動點幾下介面,就說系統安全了;AI 安全也需要更像 regression testing 的做法。AVISE 的模組化設計,正是朝這個方向走。

對團隊來說,這類框架有機會放進幾個場景:上線前驗證、模型版本升級後的回歸測試、內部紅隊流程,或是針對特定 prompt 風險的持續監控。論文沒有宣稱它已經是完整解方,但它提供了一個更接近工程現場的起點。

另一個現實面的價值,是可重現性。AI 安全測試如果每次都靠人工臨場發揮,結果通常很難比對,也很難留下紀錄。像 AVISE 這樣的框架,至少讓測試這件事更像「有方法、有輸出、有評分」的工程活動。

還有哪些限制要注意

先講最明顯的限制:摘要沒有把九個模型的名稱、25 個 test case 的細節、或每個模型的失敗模式完整列出來。所以我們無法從這份 raw 資料,推論它對不同部署情境的泛化能力。

第二個限制是,摘要呈現的數字主要是 ELM 的判定表現,不是整個框架在所有場景下的綜合安全保證。也就是說,一個判定器夠準,不代表真實世界裡的模型就安全;它只代表這個測試流程能相對可靠地分類結果。

第三個限制是,這篇摘要聚焦在 jailbreak 發現,沒有說明它是否涵蓋更廣的威脅面,例如其他型態的 AI 系統攻擊或不同部署層級的風險。就目前資訊來看,AVISE 比較像是針對語言模型安全評估的一個基礎工具,而不是全方位防護方案。

所以比較安全的讀法是:AVISE 不是最終答案,而是一塊基礎設施。它的價值在於把 AI 漏洞測試做得更系統、更能重現,也更容易整合進開發流程。對正在把模型推進產品的團隊來說,這種工具通常比單次攻擊展示更有長期意義。

如果要用一句話總結,這篇研究在做的事,就是把 AI 安全測試從「臨時抓 prompt 來試」往「可模組化、可自動化、可量化」推進一步。這一步不一定華麗,但很實用。