SpeechParaling-Bench盯住語氣細節

SpeechParaling-Bench 把語音評測從粗略標籤拉進細緻語氣控制,透過 1,000+ 中英平行查詢與 pairwise judging,直接測出模型在情境與韻律上的落差。

語音模型現在常能把字念對,卻不一定能把「感覺」說對。語氣、重音、情緒、節奏,這些人一聽就懂的細節,往往才是自然對話的關鍵。SpeechParaling-Bench: A Comprehensive Benchmark for Paralinguistic-Aware Speech Generation 這篇論文,就是要把這個落差量化,而且盡量減少語音評測常見的主觀性。

它的切入點很直接:不要只問模型會不會講話,而是問它能不能在正確的情境下,用正確的細節講話。對做大型音訊語言模型、語音助理、語音生成系統的開發者來說,這種問題比單純的發音準不準更接近真實產品需求。

這篇論文想解的痛點

論文先指出一個老問題:paralinguistic cues,也就是超越文字內容本身的語音線索,在人機互動裡非常重要,但現有評測方式沒有好好涵蓋。很多大型音訊語言模型的評估,還是停留在比較粗的特徵上,結果就是你很難分辨模型到底是真的會控制語氣,還是只是通過大方向的檢查。

這個問題會讓研究進展看起來比實際更樂觀。因為兩個輸出都可能「勉強可接受」,但聽起來就是不一樣:一個更自然、一個更貼近情境、一個更有情緒對齊感。若評測本身無法穩定抓出這些差異,模型比較就會失真。

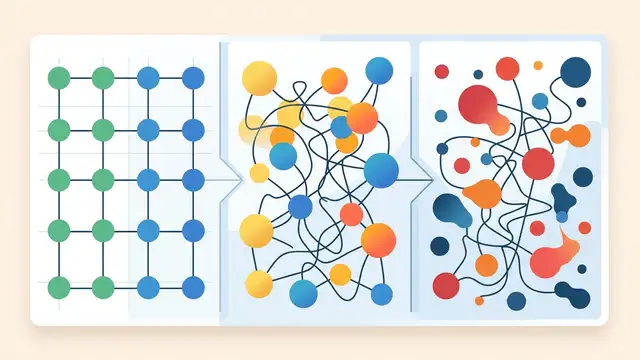

SpeechParaling-Bench 的目的,就是同時處理兩件事:一是擴大測試的特徵範圍,二是把評估方式從單純的絕對分數,改成更偏相對比較的流程。這讓 benchmark 不只是看模型「有沒有答對」,而是看它「跟基準比起來好多少」。

方法到底怎麼設計

這份 benchmark 最核心的改動,是把原本不到 50 種的特徵,擴展到 100 種以上的細粒度 paralinguistic 特徵。白話一點說,它不再把語氣當成少數幾個大類,而是拆成更細的控制面向,去對應人類實際說話時的細節變化。

這樣做的好處很明顯:如果測試項目本身夠細,模型在哪一種語氣、哪一種節奏、哪一種情境適應上出問題,就更容易被看出來。對研究者來說,這也比只看大範圍標籤更能定位瓶頸。

資料規模上,論文包含 1,000 多個英中平行語音查詢。這表示它不是只在單一語言環境下看模型表現,而是把中英文對照的語音情境一起納入測試。對想看跨語言 paralinguistic 行為的系統來說,這很重要,因為語氣控制不一定能直接從一種語言搬到另一種語言。

論文把 benchmark 分成三個任務,難度逐步上升:

- Fine-grained control:模型能不能直接產生指定的 paralinguistic 特徵。

- Intra-utterance variation:模型能不能在同一句話內做出變化,而不是整句都一樣平。

- Context-aware adaptation:模型能不能根據前後情境調整說法。

這個分法很實用,因為它把「會模仿一個標籤」和「能動態調整表達」切開來看。很多系統可能在單點控制上還行,但一進到長句、對話、或上下文切換,就會開始失真。這三層任務剛好能把這種差異拆開。

評估方法上,論文不是只用絕對分數,而是做 pairwise comparison。也就是拿候選輸出去跟固定 baseline 比,讓一個基於 LALM 的 judge 判斷哪個更好。這種方式的重點不是打幾分,而是相對於基準,誰更符合要求。

為什麼 pairwise judging 很重要

對語音這種高度主觀的任務來說,絕對分數常常很難穩。不同評審、不同時間、不同聽感條件,都可能讓同一段語音拿到不同分數。尤其是像語氣、情緒、自然度這種東西,本來就不是黑白分明。

pairwise 的優勢在於,它把判斷簡化成「兩個裡面誰比較好」。這通常比直接給一個數字更容易一致,也更容易擴大到大量樣本。論文也明確把這種 relative preference 評估,描述成一種降低主觀性、提高穩定性與可擴展性的做法,而且不需要昂貴的人工作業。

當然,這不代表問題完全解掉了。因為 judge 本身還是會有偏差,尤其當它也是一個 LALM-based judge 時,評估系統本身就變成 AI 輔助 AI。只是從工程角度看,這至少比純手工打分更容易規模化,也更適合做持續測試。

論文實際證明了什麼

論文做了大量實驗,結論很直接:現有的 LALMs 在 paralinguistic speech generation 上還有明顯限制。就算是領先的 proprietary models,也還是很難同時做好全面的靜態控制與動態調變。換句話說,模型不只是在某些細節上不穩,而是整體能力還沒到能可靠掌握語氣細節的程度。

這個結果的意義不小。它表示問題不只是資料不夠,或是開源模型比不上閉源模型而已。即使是目前領先的系統,在細粒度控制和情境適應上,仍然會出現顯著缺口。對整個領域來說,這等於是在說:語音生成的下一個門檻,不是能不能講,而是能不能講得對。

論文裡有一個數字特別值得注意:在 situational dialogue 裡,錯誤理解 paralinguistic cues 佔了 43.3% 的錯誤。這代表語氣判斷不是邊角料,而是實際對話失敗的重要來源。對互動系統來說,這種錯誤會直接影響使用者感受,甚至影響任務完成。

不過,這篇摘要沒有公開完整 benchmark 分數、各模型排名,或更細的數值拆解。所以如果你想知道哪個模型領先、差距有多大,摘要本身沒有給出那些資訊。它能確定傳達的,是目前系統在這個能力面向上仍然有明顯弱點。

對開發者有什麼影響

如果你在做語音助理、對話系統、或任何需要語音輸出的產品,這篇論文的提醒很直接:只把文字生成對,還不夠。使用者聽到的不是純文字,而是帶著態度、節奏、情境感的聲音。模型即使內容正確,聲音不對,也可能讓整體互動失敗。

對做 LALM 或 speech generation pipeline 的團隊來說,SpeechParaling-Bench 提供的是一種更嚴格的壓力測試。它逼你去看模型是否真的能控制細粒度語氣,而不是只在粗略分類上過關。這對追蹤模型進步很有價值,因為有些失敗模式在一般評測裡不容易被看見。

但它也有明確限制。首先,這仍然是一個評測框架,不是解法。它能指出問題在哪裡,卻不會直接告訴你怎麼把模型訓練得更好。其次,評估依賴 LALM-based judge,雖然比人工標註更可擴展,但 judge 的可靠性與偏差仍是需要注意的地方。

另外,摘要只明確提到英中平行語音查詢與細粒度特徵擴展,沒有提供足夠資訊說明它是否能自然外推到更多語言、更多場景,或不同類型的語音任務。對實務團隊來說,這代表它很適合拿來當診斷工具,但還不能直接視為所有語音品質問題的終點答案。

整體來看,這篇論文的價值不在於它宣稱模型已經解決語音細節,而是它把問題切得更準。當你開始認真看「語氣是否符合情境」這件事,很多看似很強的語音模型,就會露出短板。對台灣開發者來說,這也是個很實際的提醒:未來的語音產品競爭,不只是在辨識率或字詞準確度,而是在能不能把人話講得像人。

如果你的系統要面向真實對話,這種 benchmark 值得關注。因為它測的不是模型會不會出聲,而是那個聲音,能不能真的讓人覺得「對」。