LLM 評測 ASR 不只看 WER

這篇論文把 decoder-based LLM 拿來當 ASR 評測器,結果在人工一致性上明顯贏過 WER;在 HATS 的二選一任務,最佳模型達 92–94%。

自動語音辨識(ASR)做得好不好,很多團隊第一眼還是看 WER。問題是,WER 只管字對不對,不管意思有沒有被保住。這篇論文 Evaluation of Automatic Speech Recognition Using Generative Large Language Models,就是在問一個很實際的問題:生成式 LLM 能不能比 WER 更像人類一樣,判斷 ASR 輸出品質?

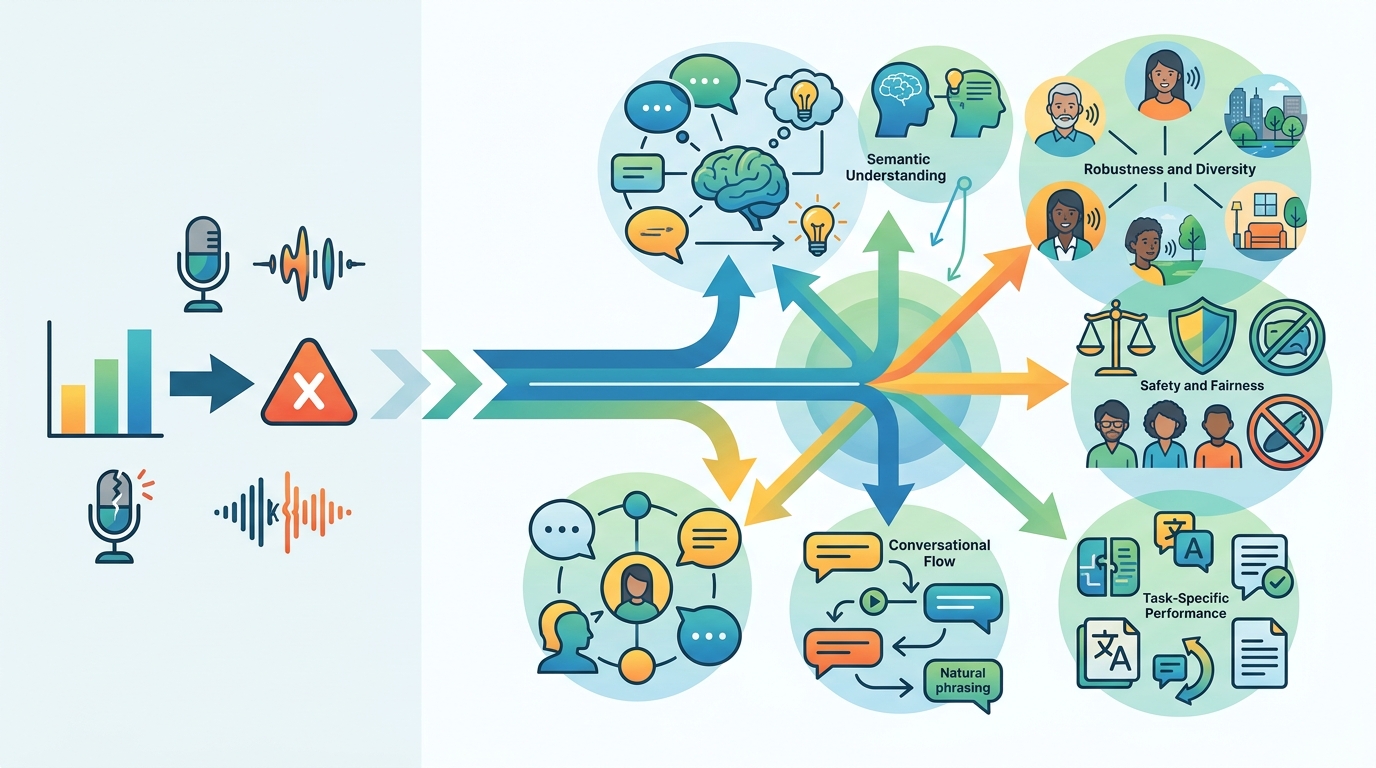

從摘要來看,答案是可以,而且在作者測的任務裡表現不錯。研究把 decoder-based LLM 拿來做 ASR 評測,分成三條路線:二選一比較兩個候選轉錄、用 generative embeddings 算語意距離、以及做錯誤類型分類。對做語音產品、模型比較或離線評估的人來說,這件事很重要,因為你選的指標,會直接影響你以為模型到底有沒有進步。

這篇不是在說 WER 沒用。比較準確的說法是,WER 太粗。當你在乎的是使用者到底有沒有聽懂、摘要系統能不能接住語意、或語音助理有沒有抓到意圖時,只看字面差異常常不夠。這也是這篇論文想補上的洞。

這篇論文想解的痛點

WER 會算字詞替換、刪除、插入,優點是簡單、好算、大家都懂。但它的核心弱點也很明顯:它對語意不敏感。兩段轉錄可能 WER 一樣,卻一段保住了原意,另一段把意思整個帶歪。對人來說,這兩者顯然不是同一回事;但對 WER 來說,可能差不多。

這就讓 ASR 評測卡住了。你如果只用 WER 來做回歸測試、比較解碼策略,或判斷某個改動有沒有提升產品品質,很容易把優化方向帶偏。模型也許在表面字串上變好了,但使用者實際感受到的品質不一定有跟著變。

作者提到,過去研究已經開始往 embedding-based 的語意評分走,希望比較的是「意思」而不是「字面重疊」。不過,decoder-based LLM 在這個角色上其實還沒被充分探索。也就是說,大家知道只看 WER 不夠,但還沒有完整驗證:生成式 LLM 能不能直接拿來當評測器,而且真的更貼近人類判斷。

這不是純學術問題。對開發者來說,評測方式會影響模型選型、資料標註、錯誤分析,甚至 CI 裡的自動化門檻。指標如果沒對準人類感知,最後可能是在優化一個不重要的數字。

方法到底怎麼運作

這篇論文沒有把方法寫成一套單一框架,而是從三個角度看 decoder-based LLM 能不能做 ASR 評測。

第一種是二選一判斷。給模型兩個 ASR 候選轉錄,讓它選出更接近原始語音的一個。這是最直觀的測法,也最接近人類在做比較時的方式:哪一個比較像原本說的話?

第二種是用 generative embeddings 來算語意距離。這裡的重點不是字對字比對,而是看模型內部表徵能不能反映兩段輸出的語意接近程度。論文把這種做法拿去和 encoder-based approaches、以及其他 semantic metrics 比較。

第三種是錯誤分類。也就是不只給分,還試著標出錯在哪裡。這對工程上很有價值,因為它讓評測不再只是單一分數,而是可以往可解釋、可操作的方向走。

摘要沒有交代太多實作細節,例如 prompt 怎麼設計、解碼設定是什麼、評測流程怎麼跑,除了提到 HATS dataset 之外,也沒有把完整 protocol 全部展開。所以就摘要本身來看,方法方向很清楚,但還不足以重建所有細節。

論文實際證明了什麼

最明確的結果出現在二選一任務。作者在 HATS dataset 上測試後發現,表現最好的 LLM 跟人工標註者的一致率達到 92–94%。同一個任務裡,WER 的一致率只有 63%。摘要也指出,這些 LLM 在這個任務上還贏過 semantic metrics。

這個差距很關鍵。因為它不是在比一個抽象分數,而是在比「誰比較像人」。如果一個評測方法更常和人類判斷一致,那它就更可能反映真實使用感受。從這個角度看,LLM-based 評測至少在這個任務上,比 WER 更接近人類直覺。

第二個結果是 embeddings。摘要說,decoder-based LLM 的 embeddings 表現和 encoder models 相當。這點有意思,因為 decoder 模型通常被看成生成器,不是特徵抽取器。這篇論文的訊息是:你不一定得另外準備一套 encoder-only 系統,decoder 模型也能提供有用的語意訊號。

第三個結果比較偏方向性。作者認為,LLM 有潛力做出更具解釋性、也更語意導向的 ASR 評測。摘要沒有提供錯誤分類任務的數字,所以這部分不能硬說有多強,只能說它被提出為一條值得走的路。

- HATS 二選一任務:最佳 LLM 與人工標註一致率達 92–94%

- 同任務的 WER 一致率:63%

- 最佳 LLM 在二選一任務上也優於 semantic metrics

- decoder-based LLM embeddings:表現可與 encoder models 相比

對開發者有什麼影響

如果你在做語音功能,評測指標其實會決定你怎麼看待產品。WER 仍然有用,尤其適合做基本回歸、版本比較、或快速看模型整體有沒有退步。但當你在乎的是語意有沒有保住,WER 就不夠了。

這篇論文的實務訊號是:生成式 LLM 可以成為 ASR 評測堆疊的一部分。它不一定要取代 WER,而是補上語意那一層。像對話式助理、語音搜尋、或任何後面還要接摘要、分類、檢索的流程,語意評分都可能比純字詞對齊更有意義。

另一個對工程團隊很實際的點,是錯誤分析。當模型不只會打分,還能幫你分類錯誤時,你比較容易看出問題是替換、刪除、還是更深層的語意偏移。這會影響你要補資料、改解碼、還是做後處理。

但這裡也要講清楚:摘要沒有說明這套方法的推論成本、穩定性、或是否容易重現。對真正在 pipeline 裡落地的團隊來說,這些都很重要。評測工具不只要準,還要便宜、可重複、可控,才有機會進 CI 或大規模實驗流程。

限制與還沒回答的問題

先講最直接的限制:摘要只提到 HATS 這一個資料集。這代表目前能公開看到的數字,還不足以證明它在更多場景都一樣成立。跨資料集、跨語言、跨任務的穩定性,摘要裡都沒有展開。

第二個限制是,摘要沒有提供完整 benchmark 細節。像是測了哪些 LLM、prompt 怎麼寫、評分是否穩定、不同模型之間差距多大,這些都沒有在摘要中公開。也就是說,結果雖然亮眼,但還不能直接拿摘要內容當成完整落地方案。

第三個問題是任務範圍。二選一比較候選轉錄,比較像受控的設定;真正上線時,你常常要評很多輸出,而且可能不是兩個選一個,而是要對一堆結果排序、打分、或做閾值判斷。摘要目前只證明了 LLM 在特定任務上很像人,還沒有證明它能完全取代既有評測方法。

所以比較務實的讀法是:這篇論文不是在宣告 WER 死了,而是在提醒大家,ASR 評測應該往「語意」靠攏。對開發者來說,這代表你可以開始把 LLM-based semantic evaluation 當成工具箱的一部分,尤其是在單看字串不夠用的時候。

如果你在做語音產品,這篇研究值得記住的地方很簡單:當你的目標是人類真的有沒有聽懂,WER 可能只是起點,不是終點。這篇論文提供的訊號是,decoder-based LLM 已經有機會成為更貼近人類判斷的 ASR 評測器,而且在摘要公開的結果裡,至少在 HATS 的二選一任務上,表現明顯優於 WER。