任務邊界會扭曲持續學習

這篇 arXiv 論文指出,串流持續學習的任務切分不是小事;同一份資料流,只要任務邊界不同,評估結論就可能改變。

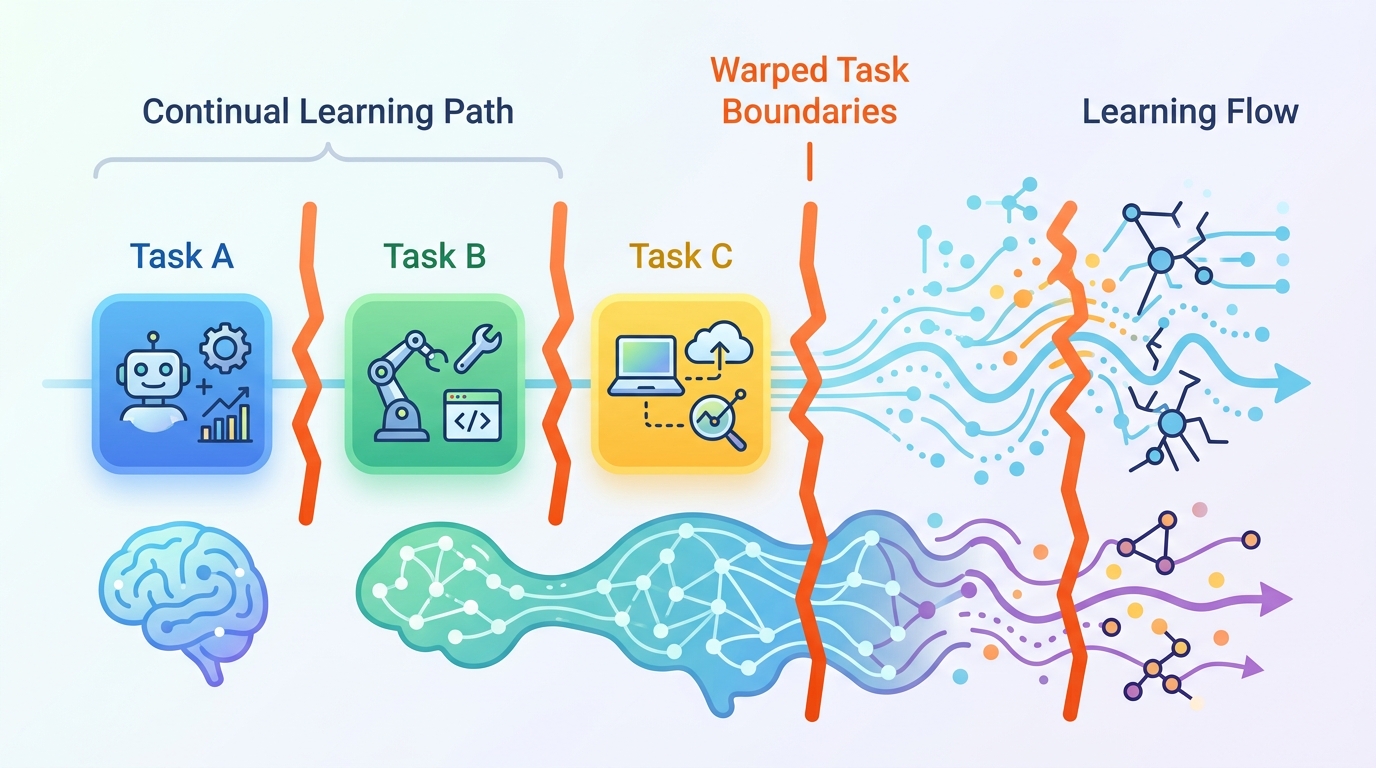

串流式持續學習常見的第一步,是把一段連續資料流切成多個任務。這篇論文要提醒大家,這一步不只是整理資料而已。它可能直接改變評估情境。也就是說,同一份資料、同一個模型、同一筆訓練預算,只要任務邊界切法不同,最後看起來「誰比較強」的答案就可能不一樣。

這對開發者很重要。因為很多人把持續學習 benchmark 當成方法比較的依據,但如果 benchmark 本身會因為切任務的方式而晃動,那結果就不只是模型差異,還混進了切分策略的影響。這篇研究把這件事講得很直接:temporal taskification,不該被當成單純前處理,而要當成評估變因來看。

這篇論文在解什麼痛點

持續學習的核心問題,是模型在看新資料時,不能把舊知識忘光。理論上很直觀,但實作上通常不會直接丟一條完整資料流進去訓練。多半會先把時間軸切成幾個任務,再讓模型一個任務一個任務學。這樣比較好定義,也比較好做 benchmark。

問題就在這裡。切分時間點不是自然真理,而是人為選擇。兩種都合理的切法,可能把同一條資料流變成兩個不同的持續學習問題。這表示,模型表現不一定只反映演算法本身,也可能反映任務邊界怎麼畫。

作者要解的,就是這個隱性不穩定性。對研究者來說,這會影響方法比較的可信度。對工程團隊來說,這會影響你要不要把某個方法帶進會隨時間漂移的真實系統。若 benchmark 對切分很敏感,那單一分數就未必足夠代表方法的穩健性。

方法怎麼運作

這篇論文沒有在模型架構上做新花樣,而是先把「任務切分」本身變成研究對象。作者提出一個 taskification-level framework,目的不是先訓練模型,而是先量化切分方式會怎麼塑造學習環境。

這個框架主要用到三個概念。第一是 plasticity profile 和 stability profile,用來描述任務切分後,學習環境在可塑性與穩定性上的樣貌。第二是 profile distance,用來衡量兩種 taskification 在結構上有多不一樣。第三是 Boundary-Profile Sensitivity,簡稱 BPS,意思是邊界只要稍微移動,整個誘發出來的 regime 會不會大幅改變。

BPS 的價值在於它抓的是脆弱度。如果一個切分只要挪一點點邊界,profile 就整個變樣,那這種 benchmark 設定可能很不穩。換句話說,模型還沒開始學,考題的出題方式就已經在改變問題本身。

這也讓這篇研究的重點很清楚:它不是在說持續學習方法沒用,而是在說你要先確認你到底在比較什麼。若任務邊界本身會改寫評估語境,那方法排名就可能沒有你想像中那麼穩定。

論文實際證明了什麼

作者把實驗放在 network traffic forecasting,資料集是 CESNET-Timeseries24。實驗設計刻意固定資料、模型與訓練預算,只改 temporal taskification。這個設計很關鍵,因為它把變因鎖得很死,才能看出任務邊界本身的影響,而不是把其他因素混進來。

他們測試的做法包含 continual finetuning、Experience Replay、Elastic Weight Consolidation,以及 Learning without Forgetting。論文比較了 9 天、30 天與 44 天的切分方式,並觀察 forecasting error、forgetting 與 backward transfer 的變化。從摘要可以確定的是,這些指標會因為 taskification 不同而出現明顯差異。

不過,這篇摘要沒有公開完整 benchmark 數字,所以這裡不能硬列表格或精準數值。能確定的是,論文明確指出:只改任務切分,就足以讓 continual learning 的評估結果出現實質變動。

另外,作者也觀察到較短的 taskification 會帶來更吵雜的 distribution-level patterns、更大的 structural distances,以及更高的 BPS。白話一點說,就是時間切得越碎,評估越容易對邊界微調產生反應。這暗示短任務切分在這個資料與設定下,可能更不穩定。

對開發者有什麼影響

如果你在做會隨時間更新的系統,這篇論文的提醒很直接:benchmark 設計本身就會影響你對方法的判斷。某個方法在一種時間切法下看起來很強,換一種切法可能就沒那麼亮眼。這對 replay 類方法、regularization 類方法,或單純 continual finetuning 都一樣。

所以實務上,不是說不要用 task-based evaluation,而是要更清楚地交代任務怎麼切,並檢查結果對切邊界的敏感度。若你的應用本來就依賴時間分段,那分段方式本身可能就是模型選型的一部分,而不是背景設定而已。

對工程團隊來說,這篇研究還有一個現實意義:不要只看單一 accuracy 或單一 forecasting error。持續學習常常還要看 forgetting 與 backward transfer,因為它們更能反映模型在新舊知識之間的拉扯。這篇論文也正是從這幾個面向去看 taskification 的影響。

- 比較方法時,先把資料流固定。

- 不要只看準確度,也要看 forgetting 與 backward transfer。

- 刻意改變任務邊界,測試結果穩不穩。

- 把 temporal taskification 視為 benchmark 定義的一部分。

限制與還沒回答的問題

這篇研究的範圍很明確,但也因此有邊界。它聚焦在 CESNET-Timeseries24 的 network traffic forecasting。這讓結果很具體,也讓論點好驗證;但同時也代表,這些發現不一定能直接搬到其他資料型態、其他任務,或其他 continual learning 場景。

它測試的方法也有限,包含 continual finetuning、Experience Replay、Elastic Weight Consolidation 與 Learning without Forgetting。摘要沒有主張所有持續學習演算法都會以同樣方式受到 taskification 影響,也沒有提出一個通用的修正方案,去消除這種不穩定性。

另一個還沒解完的問題,是要怎麼在不同資料集之間建立公平的 taskification 標準。不同資料本來就有不同的時間結構,切法很難完全一致。這篇論文已經把問題講清楚:切分方式是第一級的評估變因;但它沒有聲稱自己已經解決整個 benchmark 設計難題。

即便如此,這個訊息仍然很有用。對做串流持續學習的人來說,資料流不是全部。你怎麼切它,會改變 benchmark 想問的問題。也就是說,任務邊界不是細節,而是結果的一部分。